Apple aggiunge il rilevamento della nudità a FaceTime: una scelta tra privacy ed etica

Avrete sicuramente visto la pubblicità di Apple e Yue Yunpeng, la cui proposta principale è:

Cercando di garantire privacy e sicurezza, questo è molto tipico dell'iPhone.

Apple lo ha detto e lo ha fatto davvero. Tuttavia, quando "privacy" e "moralità" vengono messe ai due estremi della bilancia, anche Apple si trova di fronte a un dilemma.

▲ Manifesto pubblicitario frutto della collaborazione tra Apple e Yue Yunpeng. Fonte immagine: Apple

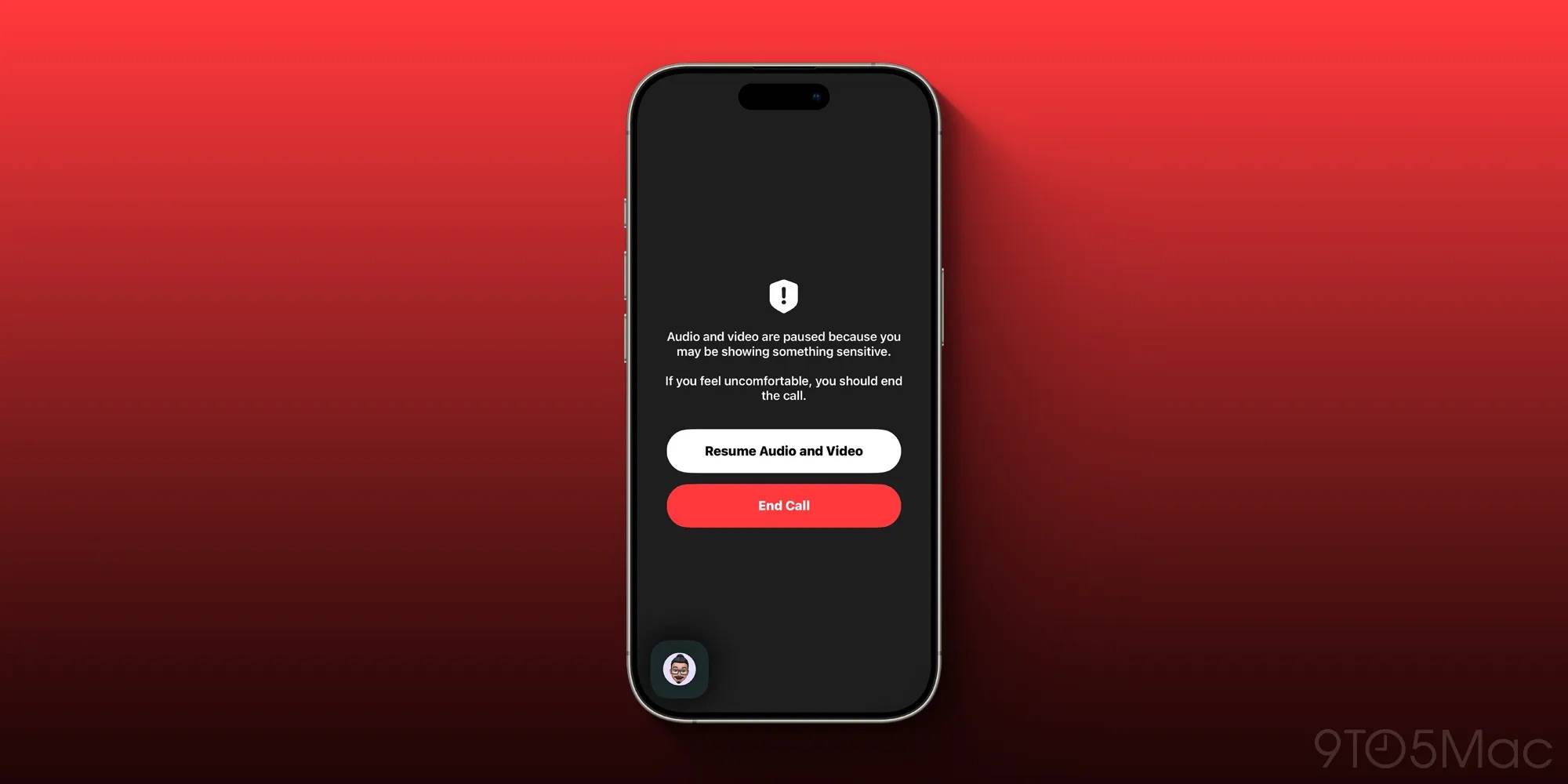

Secondo 9to5mac , Apple ha lanciato una funzionalità di rilevamento della nudità per FaceTime nell'anteprima per sviluppatori di iOS 26, che ha lo scopo di rilevare nudità inappropriate nelle videochiamate.

Si dice che Apple utilizzerà l'algoritmo di intelligenza artificiale sul dispositivo per identificare in tempo reale contenuti di nudo nelle chiamate. Quando il sistema identifica possibili scene di nudo, metterà immediatamente in pausa la videochiamata e visualizzerà un avviso.

Apple ha affermato che la funzionalità era stata originariamente progettata per essere utilizzata sugli account dei bambini, per offrire agli adolescenti un ambiente sociale digitale più sicuro.

▲ Interfaccia di FaceTime bloccata. Immagine da: 9to5Mac

Questa funzionalità ha avuto origine dal programma di scansione CSAM (materiale pedopornografico) lanciato da Apple qualche anno fa. Ma per qualche motivo, nella versione per sviluppatori di iOS 26 è stata estesa per includere utenti di tutte le età. In altre parole, anche gli utenti adulti sono "protetti".

Sebbene Apple abbia sottolineato che tutte le operazioni di riconoscimento vengono elaborate localmente sul dispositivo e che i dati non verranno caricati sul cloud, l'estensione della copertura in base all'età ha suscitato ampie polemiche sui social media. Un utente di nome krazygreekguy ha commentato su 9to5mac:

Capisco il ragionamento che c'è dietro, ma non hanno il diritto di esercitare quel tipo di controllo sugli adulti. Nessuna organizzazione ha il diritto di invadere la privacy delle persone.

▲ Immagine promozionale di Apple. Fonte immagine: Apple

In altre parole, le persone temono che questa espansione della copertura in base all'età rappresenti un'espansione del potere esclusivo di Apple, al punto da arrivare a un'eccessiva ingerenza nella vita privata e potrebbe persino estendersi a scenari che non hanno nulla a che fare con intenti pornografici.

Immagina di essere in videochiamata con tuo figlio a casa. Anche se sei a torso nudo o ti stai sistemando i vestiti, il sistema potrebbe erroneamente identificarti come inappropriatamente esposto, bloccando il video:

Il mio iPhone pensa che io sia un pervertito?

▲ FaceTime. Immagine da: Apple

FaceTime esiste da 14 anni. Essendo una funzionalità "veterana" dell'ecosistema Apple, non è la prima volta che suscita polemiche. Nel 2019, FaceTime presentava una falla tecnica che permetteva agli utenti di ascoltare la chiamata dell'interlocutore senza connettersi. Sebbene Apple abbia rapidamente risolto la falla, ha anche fatto dubitare molti delle reali capacità di protezione di Apple, a causa della retorica della propaganda sulla privacy.

▲ Immagine promozionale di Apple. Fonte immagine: Apple

Apple ha sempre attribuito grande importanza alla tutela della privacy degli utenti, valore fondamentale dell'azienda.

Chi segue Apple da molto tempo ricorderà forse l'incidente del 2015, quando Apple affrontò l'FBI. Dopo la sparatoria di San Bernardino in California, l'FBI chiese di sbloccare l'iPhone utilizzato dall'assassino per ottenere informazioni sulle attività terroristiche, ma Apple rifiutò. All'epoca, il CEO di Apple, Tim Cook, dichiarò: " Una volta aperta la backdoor, non può essere chiusa, il che metterebbe a repentaglio la sicurezza e la privacy di tutti gli utenti".

▲ Interfaccia FaceTime. Immagine da: Apple

Tuttavia, Apple ha anche suscitato qualche polemica a causa di problemi di privacy. Ad esempio, il piano di scansione CSAM menzionato sopra è stato anch'esso criticato al momento del suo lancio.

A partire da iOS 15 nel 2021, Apple utilizza la tecnologia NeuralHash sui dispositivi locali per confrontare i valori hash delle foto caricate dagli utenti su iCloud con il database CSAM gestito da autorevoli agenzie statunitensi. Al superamento della soglia preimpostata, Apple decripta i dati rilevanti ed esegue una revisione manuale. Dopo la conferma, l'account viene disabilitato e segnalato al National Center for Missing and Exploited Children (NCMEC).

Apple sostiene che lo scopo di questa funzione è quello di individuare e catturare i molestatori sessuali su minori, di proteggere al massimo la privacy degli utenti dal punto di vista tecnico e di evitare errori di valutazione e abusi.

Tuttavia, le organizzazioni per la protezione della privacy e gli esperti di sicurezza hanno messo in dubbio la possibilità che Apple si discostasse dal suo impegno costante in materia di protezione della privacy. Dopotutto, la scansione CSAM identifica essenzialmente le informazioni private caricate dagli utenti. Sotto pressione, Apple ha annunciato che avrebbe posticipato il rilascio di questa funzionalità e lanciato invece altre misure di protezione dei minori, come la sicurezza delle informazioni e delle comunicazioni e le funzioni di intervento nella ricerca di Siri.

Per Apple, "moralità" e "privacy" potrebbero non essere conseguibili contemporaneamente.

Tornando al rilevamento della nudità su FaceTime menzionato all'inizio: secondo l'intenzione originale di Apple, questa è una funzione di sicurezza lanciata per proteggere meglio gli adolescenti. Aiuta a impedire che gli adolescenti siano esposti a nudità inappropriate durante le videochiamate. Ci sono innumerevoli casi simili di molestie sessuali e frodi nelle videochiamate da dispositivi mobili in tutto il mondo. Con oltre un miliardo di utenti, Apple dovrebbe davvero assumersi tale responsabilità sociale.

Ma d'altro canto, resta una questione importante dove si collochino i confini di questo "intervento automatico".

Quando la moralità pubblica e la privacy personale sono poste ai due estremi della bilancia, come soppesare i pro e i contro e prendere la decisione "giusta" potrebbe rappresentare un problema per Apple per molto tempo.

Autori: Zhou Qiantong, Xiao Qinpeng

#Benvenuti a seguire l'account pubblico ufficiale WeChat di iFanr: iFanr (ID WeChat: ifanr), dove vi verranno presentati contenuti ancora più interessanti il prima possibile.