L’applicazione di intelligenza artificiale di Apple non è la stessa di ChatGPT

Una delle funzioni principali del dispositivo di realtà mista XR di Apple ruota attorno al servizio Fitness+.

Utilizzerà lo spazio virtuale per immergerti nella “palestra” ovunque e, naturalmente, è indispensabile un allenatore virtuale.

In precedenza, pensavamo solo che questo “allenatore virtuale” potesse fornire solo dimostrazioni di azioni standard, ma nel piano di Apple, “lui” potrebbe anche essere dotato di più “saggezza”.

È stato riferito che per espandere l’universo sanitario di Apple Watch, Apple intende introdurre l’intelligenza artificiale nelle funzioni sanitarie.

Avvia un coach della salute AI, con l’aiuto dei dati registrati dall’Apple Watch, con l’aiuto di algoritmi, per formulare il piano di esercizi dell’utente, migliorare le abitudini alimentari e la qualità del sonno, al fine di mantenere o migliorare lo stato di salute.

Questa dovrebbe essere l’ultima notizia che AI e Apple si sono riunite di recente, ma l’allenatore per la salute dell’IA di Apple è significativamente diverso dall’attuale popolare IA generativa, come ChatGPT, bing e Bard.

“AI Health Coach” è più simile a una funzione che a una tendenza simile a ChatGPT che attiva una nuova traccia.

Apple non ha interrotto l’ascesa della Silicon Valley per affrettarsi a costruire un’IA generativa, invece sembra essere una prigione e non partecipa alla competizione, il che sembra molto diverso.

Siri non è AI, l’IA di Apple è nelle minuzie

Dodici anni fa, Apple ha rivelato per la prima volta Siri al pubblico e lo ha introdotto sul mercato con l’iPhone 4s.

Successivamente, Siri è stato esteso a tutti i dispositivi smart Apple come Mac, iPad, HomePod, Apple Watch e persino AirPods.

Siri nasce con High Light ed è definito come un “assistente vocale intelligente”, in grado di rispondere alle domande degli utenti, controllare i dispositivi ed eseguire attività attraverso il riconoscimento vocale e l’elaborazione del linguaggio naturale.

Ha anche guidato la tendenza degli assistenti vocali standard negli smartphone, come Bixby di Samsung, Xiao Ai di Xiaomi, Xiaoou di OPPO e così via.

Allo stesso modo, anche Siri è ben noto al pubblico ed è considerato un prototipo di intelligenza artificiale.

Tuttavia, durante il processo di evoluzione durato 12 anni, Apple ha apportato raramente aggiornamenti approfonditi, principalmente attorno a punti funzionali.

Oggi mantiene ancora l’innocenza del 2011. Di fronte a problemi difficili, risponde anche onestamente “Non lo so molto bene. Questa è la risposta che ho trovato su Internet”.

Oggi, quando l’IA generativa sta volando in tutto il cielo nel 2023, l ‘”innocenza” di Siri è in netto contrasto con l’eloquente ChatGPT.

Sembra che Apple non voglia sviluppare l’intelligenza artificiale, ma voglia solo vendere cellulari e computer, ma è davvero così?

In effetti, Siri non dovrebbe essere chiamato intelligenza artificiale, Siri è solo un assistente vocale del tipo di database di risposte.

Quando l’utente lo riattiva e invia una serie di istruzioni, il suo modello di dati verrà prima elaborato sull’ontologia, verificando rapidamente se si tratta di una semplice richiesta locale (come la regolazione del volume, l’impostazione della sveglia, ecc.) e utilizzando informazioni note per completarlo rapidamente.

Altrimenti, vai sul cloud per interrogare un database più grande e darti una risposta, o se non lo trovi, lancia semplicemente una ricerca sul web (alta probabilità).

Tuttavia, ChatGPT non ha un processo da locale a cloud.Secondo la domanda, visita direttamente il centro di cloud computing Azure di Microsoft, utilizza un’enorme potenza di calcolo e modelli corrispondenti per calcolare e “genererà” una risposta se è compresa o non.

Da questo punto di vista, Siri e ChatGPT mostrano due tendenze: Apple tende a implementare la tecnologia localmente ea dare priorità alla potenza di calcolo locale. ChatGPT si affida interamente alla rete e all’enorme potenza di calcolo del data center.

Lo stesso vale per l’intelligenza artificiale di Apple, che è nascosta in molte funzioni dei prodotti Apple, che è del tipo che nessuno noterà, ma migliora notevolmente l’esperienza dell’utente.

Ad esempio, se premi l’otturatore, l’iPhone scatterà più foto di seguito, quindi utilizzerà il riconoscimento dell’immagine per selezionare quella con l’effetto migliore come immagine finale in base all’algoritmo del modello corrispondente.

Oppure, quando Apple Pencil scrive sull’iPad, può eguagliare la vera esperienza con carta e penna. In esso vengono utilizzati il rilevamento dei tratti e il riconoscimento del palmo, pur garantendo una risposta in tempo reale ai tratti, non verrà toccato accidentalmente perché il palmo tocca lo schermo.

Inoltre, FaceID tiene conto sia della sicurezza che dell’efficienza, può adattarsi ai cambiamenti del volto dell’utente e non influirà sull’efficienza del riconoscimento a causa di occhiali e barba.

Anche nell’attuale iOS, lo sblocco della maschera è supportato e viene utilizzata solo mezza faccia per completare lo stesso livello di sicurezza di prima.

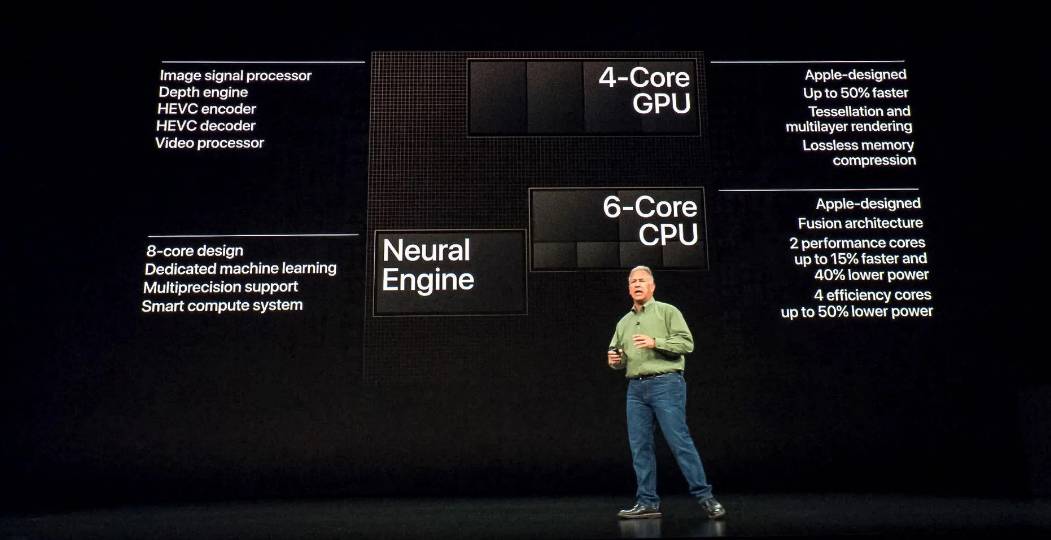

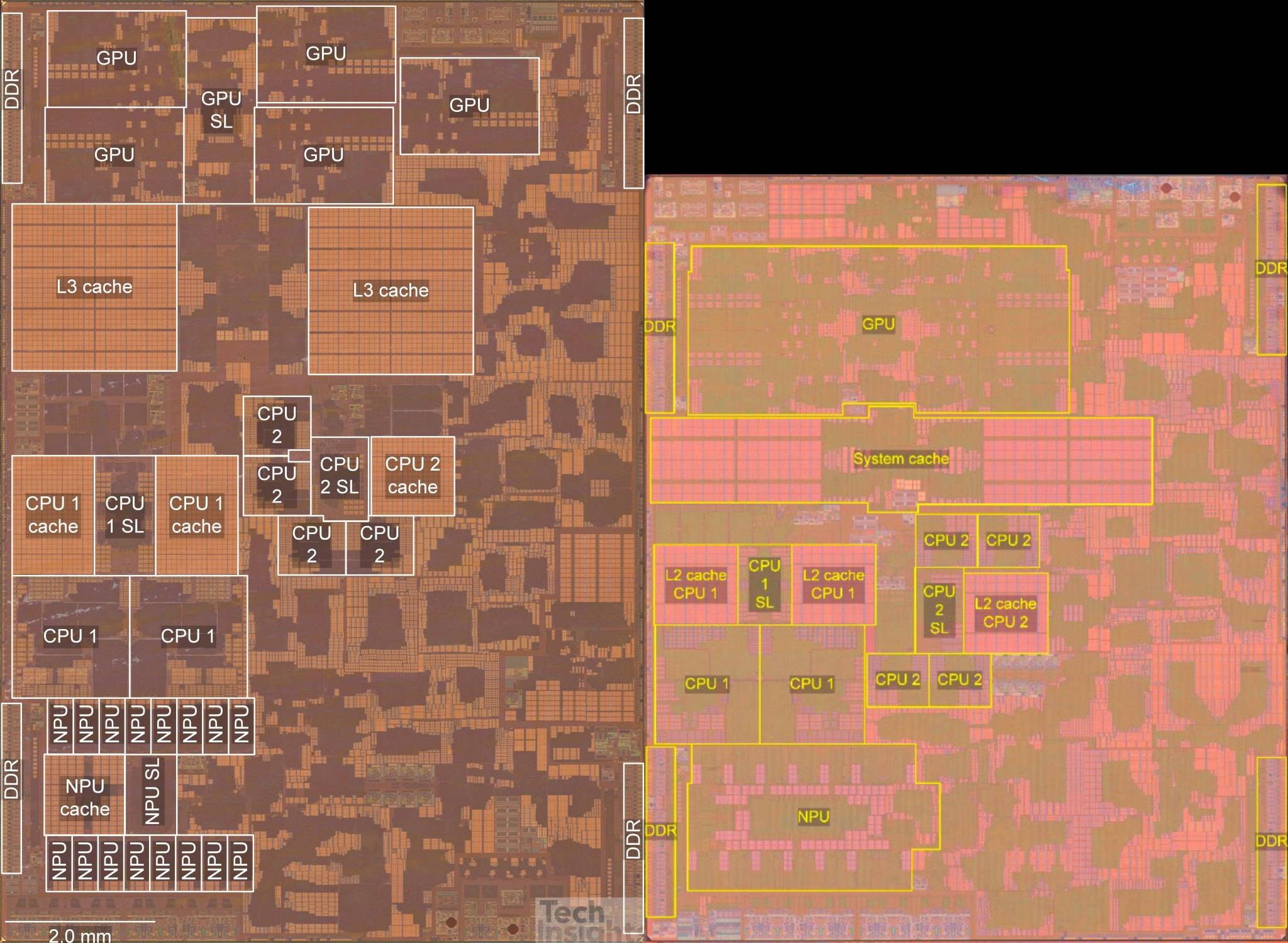

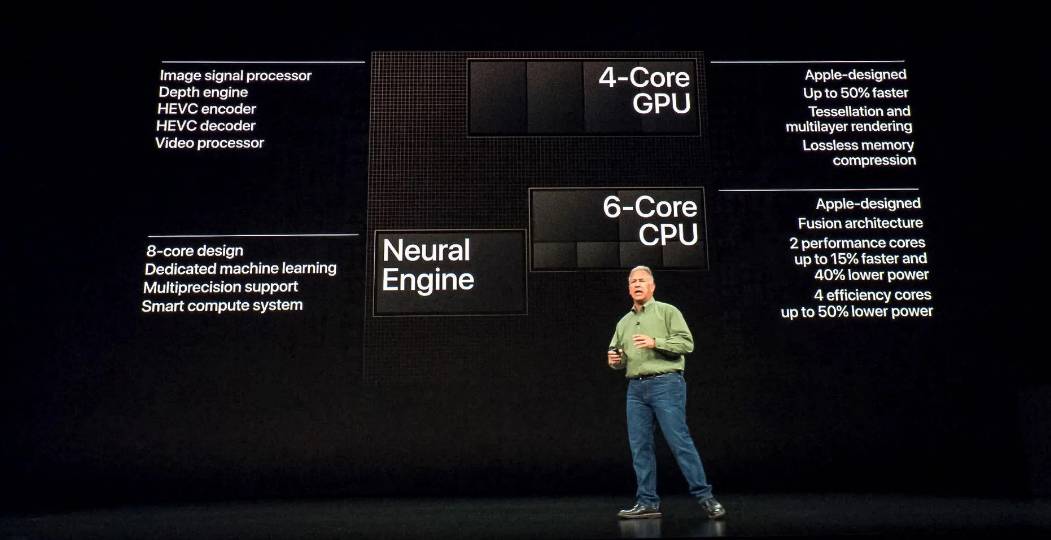

▲ Anatomia del chip bionico A15 e del chip bionico A14, il motore di calcolo neurale è concentrato nell’angolo in basso a sinistra

Da queste funzioni alle funzionalità multi-dispositivo, collaborazione tra piattaforme e interconnessione di Apple, il Neural Engine (motore neurale) di Apple è coinvolto in tutti gli aspetti, che è anche il modo in cui viene presentata l’IA di Apple.

A differenza dell’IA generativa, l’IA di Apple si concentra su come migliorare l’esperienza degli utenti finali.

È possibile che Siri diventi simile a ChatGPT?

Poco dopo il lancio di ChatGPT, anche le app shell in versione web che accedono all’API ufficiale sono emerse in un flusso infinito, ma possono davvero essere incorporate nel sistema o non essere ancora state implementate nelle applicazioni e nelle interazioni del terminale.

Questo è il motivo per cui in precedenza si credeva che l’IA generativa come ChatGPT e il nuovo bing fossero ancora bloccati nell’antica interazione della finestra di dialogo.

![]()

La vera interazione uomo-computer, o servizi terminali, non è ancora stata prodotta.

Il CEO di OpenAI Sam Altman ha dichiarato in un discorso al Massachusetts Institute of Technology: “L’era dei modelli su larga scala è giunta al termine. Dobbiamo utilizzare nuove idee e metodi per fare nuovi progressi nell’AIGC”.

▲ Sam Altman, CEO di OpenAI Immagine da: cablata

Pur rivelando la tendenza allo sviluppo del settore AIGC, implica anche che le nuove aziende tecnologiche entrano nel mercato: “Sei già al passo con i tempi”.

Questa è in realtà un’opportunità per Apple, che ha perso la prima ondata di AIGC: non è necessario utilizzare risorse per addestrare il proprio modello linguistico, ma dovrebbe considerare come incorporare l’IA generativa nella propria ecologia.

Invece di reinventare la ruota, prendi in considerazione la costruzione di un’auto.

Per quanto riguarda Siri, da tempo in disuso, su Siri si può innestare il modello del linguaggio grande, trasformandolo in uno Smart Siri, rendendolo una governante intelligente in grado di controllare tutti i dispositivi ecologici Apple sotto un ID Apple (simile a Javis), portando così una nuova forma di interazione uomo-macchina.

È solo che riportare in vita Siri potrebbe non essere così semplice come previsto, integrando un modello di linguaggio di grandi dimensioni nell’algoritmo originale di Siri.

Trasformare Siri in un ChatGPT simile, poiché i due processi sono completamente diversi, è quasi necessario eseguire il refactoring dell’intero database Siri, il che equivale a respingere e ricostruire, il che potrebbe richiedere la riorganizzazione del team e la spesa di molte risorse per riorganizzare -dock con il sistema hardware.

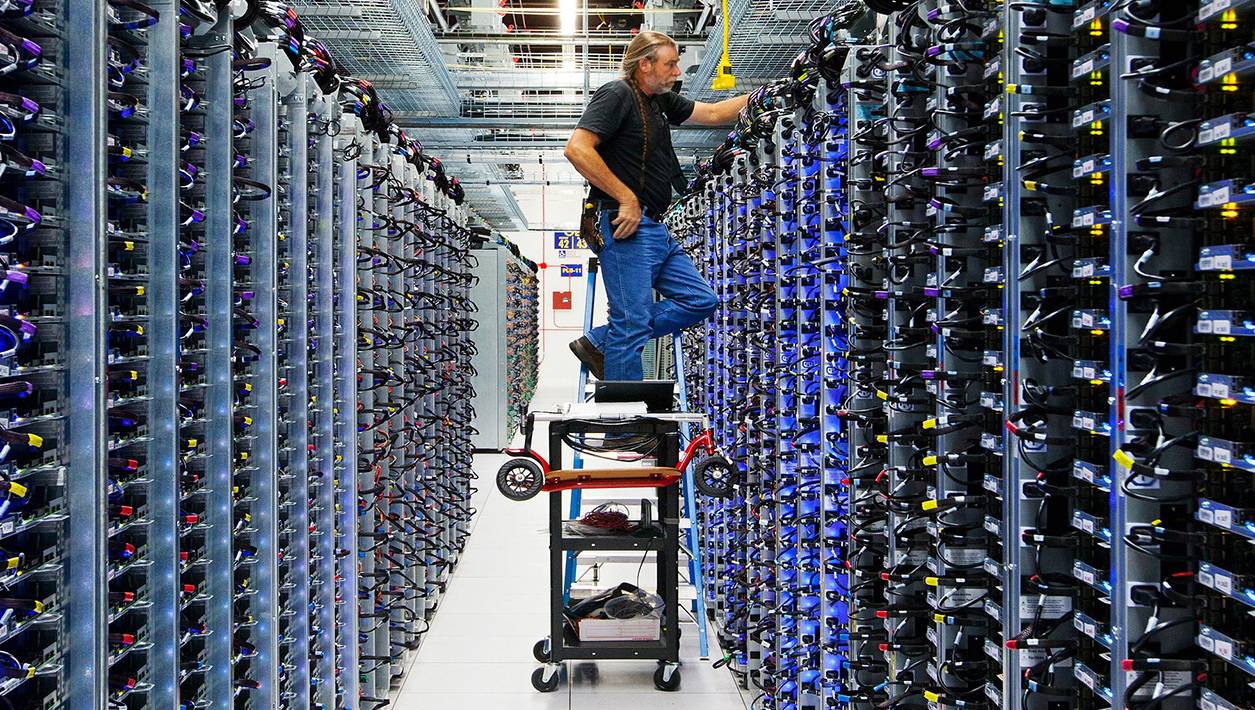

▲ Immagine del Google Machine Learning Center composta da TPU v4 di: Google

Inoltre, abbiamo anche segnalato in precedenza che AIGC consuma molta potenza di cloud computing ogni volta che viene generata una query.

Al momento, ChatGPT di OpenAI ha quasi esaurito le risorse di calcolo del centro di cloud computing Azure di Microsoft, ed è anche un po’ stretto.

La scala del centro di cloud computing di Apple è piccola e la sua scala globale è di gran lunga inferiore a quella delle grandi aziende tradizionali come Microsoft e Oracle che forniscono servizi cloud al mondo esterno. I servizi cloud Apple sono per lo più autocompiacimento, fornendo supporto per iCloud, App Store e altre attività.

Se AIGC viene introdotto su iPhone, iPad e Mac, la potenza di calcolo richiesta da Apple sarà astronomica.

Anche se Apple ha il supporto della potenza di calcolo, secondo i calcoli precedenti, il costo di GPT-4 per mille parole rapide arriva fino ai centesimi 12. Inoltre, Apple ha più di un miliardo di utenti iPhone in tutto il mondo e il costo dell’operazione è estremamente elevato.

Indipendentemente dalle condizioni oggettive o dai desideri soggettivi di Apple, è difficile per Apple introdurre direttamente la tecnologia simile a ChatGPT in Siri e distribuirla direttamente nell’ecosistema.

Apple deve ancora trovare una tempistica e un punto di ingresso adeguati, che potrebbero essere la riduzione dei costi dell’IA generativa o iniziare con una piccola funzione e utilizzare l’AIGC per migliorare l’esperienza dell’utente.

A giudicare dall’atteggiamento coerente di Apple nei confronti dell’IA, è più probabile che quest’ultimo sia l’approccio finale di Apple.

Per l’intelligenza artificiale, Apple apprezza “efficienza” e “privacy”

Oltre alle tempistiche, ci sono anche differenze nelle strategie e nelle tattiche delle due società che mantengono la calma Apple e l’IA generativa.

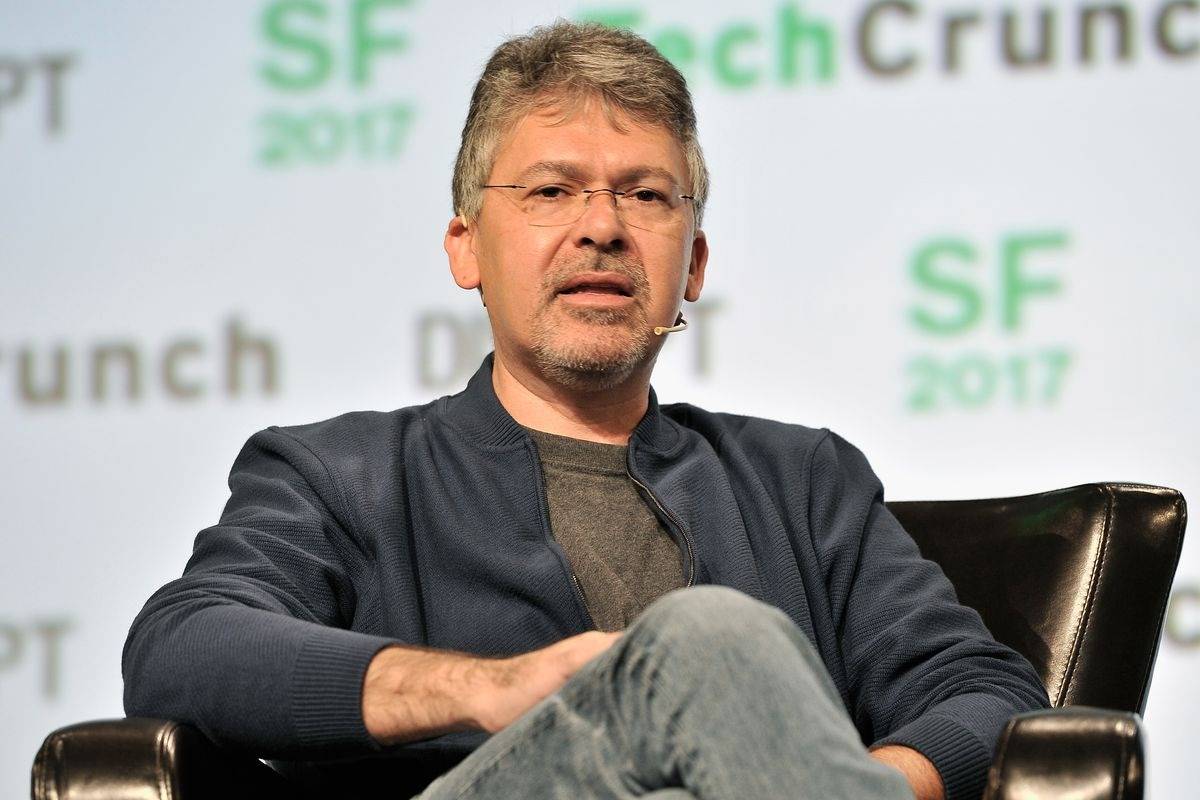

▲ John Giannandrea Immagine da: TechCrunch

Nel 2020, John Giannandrea, vicepresidente senior della strategia di machine learning e intelligenza artificiale di Apple, e Bob Borchers, vicepresidente del marketing di prodotto, hanno entrambi espresso con fermezza due punti chiave della strategia AI di Apple in un’intervista con Arstechnica sull’attività di Apple relativa all’IA.

Uno è l’efficienza e l’altro è la privacy.

L’efficienza si riferisce alla risposta più rapida e alle migliori prestazioni degli algoritmi e dei modelli di machine learning eseguiti localmente.

La privacy, come suggerisce il nome, è la protezione della privacy.

In questa intervista di quasi diecimila parole, queste due strategie chiave sono state ripetutamente menzionate da John Giannandrea, il che dimostra che Apple ha una ricerca quasi paranoica e rigorosa della tecnologia AI.

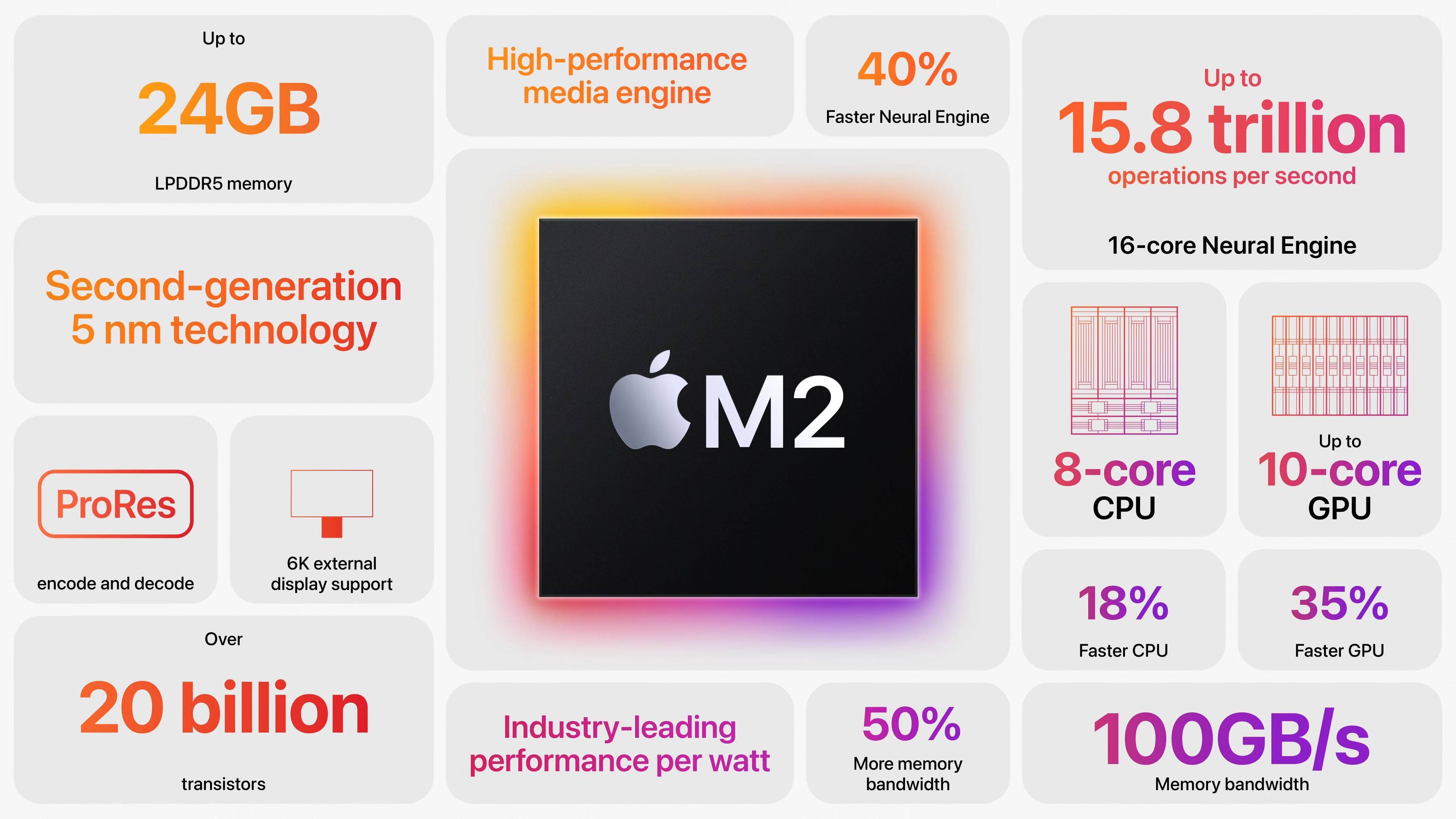

Guardando indietro ora, le due insistenze di Apple hanno anche spinto Apple a dare la priorità ai motori neurali Apple serie A e serie M rispetto a CPU e GPU nel core business, diventando il cuore di ogni generazione di chip.

È interessante notare che, quando verrà rilasciata ogni generazione di chip Apple serie A e serie M, Apple annuncerà una serie di specifiche correlate e informazioni sull’architettura come CPU, GPU e memoria unificata.

Ma solo quando si tratta di Neural Engine, ci sono solo dati generali, più simili a una scatola nera, come se il motore neurale fosse il più grande segreto di tutti i chip.

Inoltre, i due dirigenti ritengono anche che il motore neurale di Apple, incluso nel chip sin dall’iPhone X, sia un prerequisito per la realizzazione di algoritmi di intelligenza artificiale locali per l’elaborazione interna alla macchina.

A tal fine, Apple ha ridotto il più possibile le dimensioni di molti algoritmi di machine learning in modo che possano essere implementati localmente. Ha anche sottolineato che rendere il modello dell’algoritmo più piccolo è la vera abilità.

Distribuito localmente, l’algoritmo del modello può essere rapidamente chiamato localmente senza ritardi nella risposta. Inoltre, non è necessario caricare i dati dell’utente, il che evita il problema della “privacy”.

Tra le funzioni a cui partecipa l’intelligenza artificiale, come il tracciamento dei tratti di Apple Pencil, il riconoscimento delle immagini, ecc., Poiché il modello dell’algoritmo è addestrato abbastanza bene, non è necessario caricarlo nel cloud per assistere i calcoli e l’elaborazione può essere completata localmente.

Simile all’IA generativa di ChatGPT, è completamente dipendente dalla rete: anche dopo diversi mesi di lancio, il servizio non è ancora abbastanza stabile e di tanto in tanto possono verificarsi errori.

Per un’azienda come Apple che persegue l’esperienza utente, una situazione così instabile non è consentita.

La protezione della privacy è stata una strategia di Apple negli ultimi anni: nonostante le critiche e la riduzione dei relativi vantaggi, Apple ha comunque lanciato l’App Tracking Transparency Framework (App Tracking Transparency, in breve ATT) su iOS 14.5.

Alcuni degli algoritmi del modello AI di Apple non hanno bisogno di essere connessi a Internet, mentre altri hanno bisogno di raccogliere alcuni dati per l’addestramento (come Siri).Per questo motivo, Apple dichiarerà in anticipo e rimuoverà le informazioni sensibili (come ID Apple, ecc.) durante il processo di raccolta.

L’attuale popolare IA generativa è in qualche modo diversa dall’atteggiamento cauto di Apple, che quasi prende un sacco di contenuti Internet per l’addestramento dei parametri dell’algoritmo e lo genera sulla base di questo.

E quando hanno lanciato prodotti correlati, come Microsoft Copilot, Midjourney e Stability AI, hanno anche ricevuto azioni legali per violazione da molti siti Web e istituzioni, sostenendo che queste società hanno illegalmente cancellato e creato contenuti protetti da copyright, che violavano la legge sul copyright.

▲ Gioconda generato da Midjourney

Sebbene il dibattito sul diritto d’autore non si sia ancora concretizzato, un processo di formazione così controverso è in realtà contrario all’obiettivo principale di Apple per la protezione della privacy dei dati.

Al momento AIGC non può essere implementato localmente ed è difficile garantire un servizio perfetto quando si è connessi a Internet.Inoltre, ci sono problemi di riservatezza dei dati.

La tecnologia mainstream di AIGC è quasi in contrasto con la ricerca dell’IA da parte di Apple, il che spiega anche l’incapacità di Apple di intervenire in tempo e rilasciare prodotti o dichiarazioni corrispondenti sull’IA generativa.

Per l’IA, forse conosciamo Siri, ma per la stessa Apple, infatti, da quando il Neural Engine è diventato un modulo indipendente dei chip della serie A, Apple si è concentrata sulla localizzazione dell’IA, lo scopo è anche molto puro e non vuole utilizzare l’IA Cambiare il mondo significa migliorare l’esperienza dell’utente.

Apple non è una pura azienda di intelligenza artificiale. Il data center cloud è solo per la propria attività di software. La produzione di base è anche per l’hardware. L’espansione del settore tecnologico di Apple è per i servizi di prodotto. Dopo tutto, è un’azienda orientata al prodotto.

La sua strategia, strategia, layout tecnologico, ecc. Riguardano il servizio del prodotto principale. Come il dispositivo XR che verrà lanciato in seguito, Apple sta espandendo il team AI nel riconoscimento visivo e non sta inseguendo i punti caldi della Silicon Valley.

Apple è molto chiara sui propri punti di forza e di debolezza e non è guidata ciecamente da altri, ma utilizza una strategia di sviluppo molto stabile da definire.

Inoltre, Apple osserva sempre a lungo le nuove tecnologie e le nuove tendenze e interviene dalla sua prospettiva unica: per quanto riguarda l’IA generativa, Apple potrebbe anche svilupparsi in una direzione che non ci aspettavamo e ci aprirà gli occhi.

#Benvenuti a prestare attenzione all’account pubblico WeChat ufficiale di Aifaner: Aifaner (ID WeChat: ifanr), altri contenuti interessanti ti verranno presentati il prima possibile.

Ai Faner | Link originale · Visualizza i commenti · Sina Weibo