Il Metaverso, qualche piccolo passo avanti nel 2022

C’è una battuta sul fatto che alcune persone mangiano panini al vapore e si sentono sazi quando mangiano il terzo panino, quindi si lamentano dicendo che sarebbe stato meglio se avessero mangiato il terzo panino al vapore, i primi due panini al vapore erano assolutamente inutili.

Sebbene poche persone siano così stupide in realtà, errori cognitivi simili sono comuni: precipitarsi verso una visione tecnologica e ignorare il processo di progresso tecnologico.

Dopo aver sperimentato un’ondata di mania del metaverso l’anno scorso, la parola è apparsa meno frequentemente ora, la marea è svanita e nuotatori nudi sono apparsi uno dopo l’altro.Non necessariamente soli.

Il 2022 è il periodo di raffreddamento per il metaverso per svanire. Come ho detto in “The Metaverse Needs “Infrastructure Crazy” l’anno scorso, il metaverse del sapore originale è ancora lontano, ma l’infrastruttura del metaverse si è già aperta schermo.

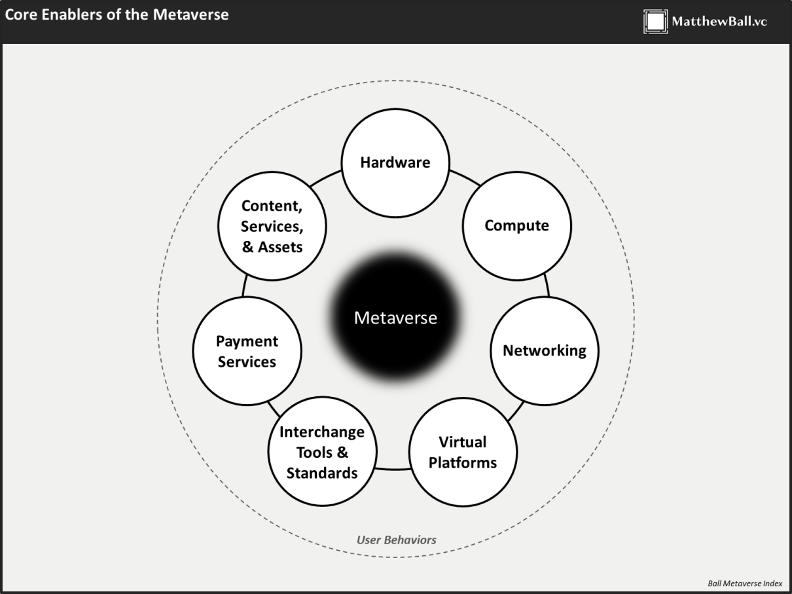

La serie di articoli dell’investitore e analista Matthew Ball “Framework for the Metaverse” (Metaverse Framework) divide gli elementi architettonici di base del Metaverse in “hardware, computing, rete, piattaforma, strumenti, interazione, pagamento, contenuto”, ecc. Molti aspetti.

In quanto direzione di evoluzione a lungo termine della tecnologia di consumo e industriale e di Internet, Metaverse non sarà un monopolio, ma il risultato di una co-creazione multipartitica, ad esempio Meta si concentra su hardware, piattaforma e contenuti e ByteDance & Pico sono anche simili, e Qualcomm è sicuro che si concentri su tecnologie di base come l’informatica e il networking, mentre Unity fornisce strumenti Per quanto riguarda il pagamento, è probabile che sia tecnologia blockchain distribuita…

Pertanto, oggi vediamo molte pietre miliari di nuovi prodotti e nuove tecnologie.Se sono inseriti in una visione così grandiosa di questo metaverso, in realtà sono più come dei mattoni, piccoli ma cruciali.

Il Metaverse non è l’ultimo mattone quando la sua tecnologia è completamente matura, ma una raccolta di innumerevoli mattoni avanti.

Possiamo vedere, nel 2022, quali nuovi mattoni emergono per quanto riguarda il metaverso. Ma Huateng, il fondatore di Tencent, definì il Metaverso “l’interconnessione completamente reale” e le sue prestazioni specifiche risiedono in: la presentazione reale dei sensi multidimensionali, la connessione completa di enormi informazioni, la libera interazione delle operazioni uomo-computer , e l’integrazione organica della realtà virtuale… Questo è un nuovo modo di connettere digitale e fisico, attraverso il tempo e lo spazio.

Meta inizia a sfidare il “Visual Turing Test”

Nel 2022, nel campo del metaverso, uno sviluppo fondamentale è che Meta ha recentemente mostrato 4 macchine ingegneristiche, sfidando ufficialmente il “Visual Turing Test”.

Come tutti sappiamo, il test di Turing serve a verificare se l’intelligenza artificiale può raggiungere la stessa intelligenza degli esseri umani.

Il test visivo di Turing serve a verificare se la scena della realtà virtuale visualizzata dal dispositivo VR può ingannare l’occhio umano e il cervello umano, facendo pensare alle persone che il mondo di fronte a loro sia il mondo reale.

Sebbene gli attuali dispositivi VR possano fornire scene molto realistiche e spaziali, a causa della densità dei pixel, della luminosità del display, dell’esperienza di utilizzo e di altri motivi, siamo ancora molto chiari sul fatto che questa realtà sia virtuale.

Quindi, che si tratti della sfida di Meta del “Test di Turing visivo” o della “presentazione reale dei sensi multidimensionali” di Tencent, stanno definendo una tabella di marcia per lo standard dell’esperienza sensoriale del Metaverso.

Nel giugno di quest’anno, Meta ha annunciato quattro prototipi VR e concept machine, nomi in codice: Butterscotch, Starburst, Holocake 2 e Mirror Lake.

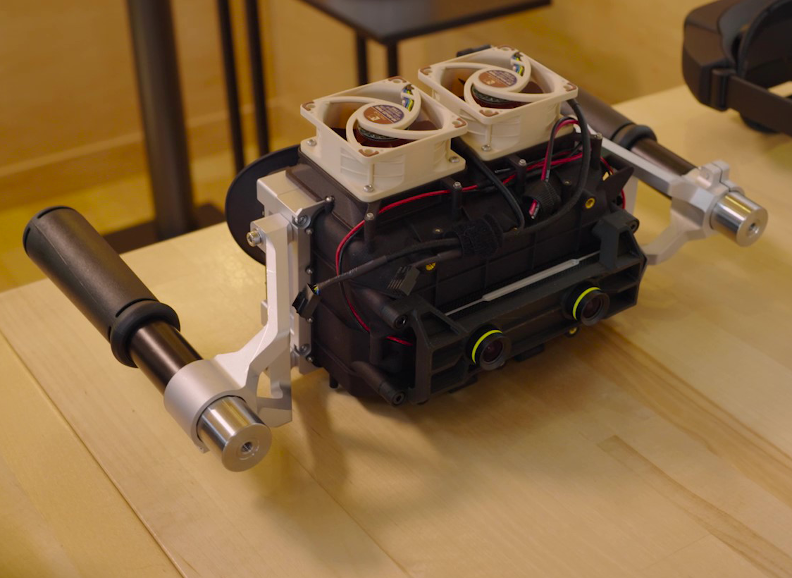

▲ Prototipo Starburst

Questi prodotti rappresentano diverse direzioni tecniche in cui i prodotti VR devono essere infranti uno per uno: Butterscotch si concentra sull’alta risoluzione a livello di retina; Starburst si concentra su una luminosità ultraelevata di 20.000 nits e sul display HDR; Holocake 2 vuole risolvere il problema delle dimensioni ridotte e leggere Prodotti VR; Come per Mirror Lake, è una macchina concept in fase di verifica, e non c’è un vero display della macchina. Unisce i vantaggi di tutti i precedenti prototipi, alta definizione, luminosa e sottile.

Oltre a questi prototipi, ci sono anche i prototipi della serie Half Dome che Meta sta sviluppando, questa serie risolve principalmente il problema che la visualizzazione dei prodotti VR non può essere zoomata. Poiché gli attuali prodotti VR di consumo utilizzano tutti componenti ottici a lunghezza focale fissa, la lunghezza focale è solitamente compresa tra 1,5 e 2 metri, quindi indipendentemente da dove guardiamo il prodotto VR, la luce proviene dalla stessa distanza, ma l’occhio umano e il cervello umano non riesce a rilevare questa domanda. Pertanto, la mancata corrispondenza tra la distanza di simulazione dello schermo virtuale dei prodotti VR e la distanza di messa a fuoco degli occhi umani porterà a un conflitto tra Vergence-Accommodation Conflict/VAC.Questo conflitto è il risultato diretto di molte persone che indossano prodotti VR e sentono l’affaticamento degli occhi.

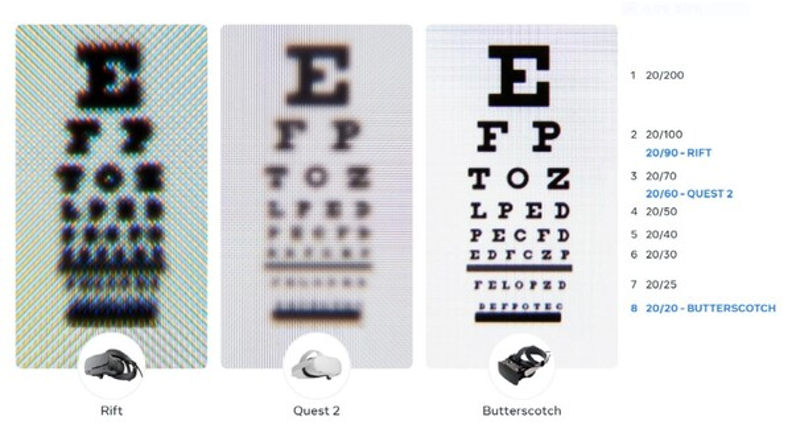

La risoluzione è la parte più critica della simulazione di scene reali e del superamento del test visivo di Turing.

Nel campo degli smartphone e dei computer, si dice spesso “schermo retina”, il che significa che dopo che la densità di pixel (PPI, Pixel per pollice, pixel per pollice) dello schermo raggiunge un certo livello, l’occhio nudo non riesce a distinguere i pixel, ma perché le persone A seconda della distanza tra la visualizzazione di un telefono cellulare e di un computer e della disposizione dei pixel dello schermo del display, non esiste una definizione precisa di quale densità di pixel soddisfi lo standard retina.

Nel campo della VR, gli schermi retina devono introdurre un’altra dimensione di valutazione: PPD (Pixels Per Degree, il numero di pixel per grado), perché il campo visivo visualizzato dalla VR è molto ampio, arrivando solitamente a circa 110 gradi, quindi anche se I prodotti VR adottano uno schermo di livello 4K (4320 × 2160, occhio singolo 2160 × 2160), quindi il PPD dello schermo di visualizzazione VR è 2160 pixel ÷ 110 gradi = 19,6, che è anche l’effetto di visualizzazione degli attuali prodotti VR tradizionali.

L’industria VR o metaverse generalmente crede che lo standard retina dei prodotti VR dovrebbe raggiungere 60 PPD.Se può raggiungere 120 PPD, il realismo raggiungerà uno stato molto ideale. Si può vedere che c’è un grande divario tra i prodotti esistenti e il valore ideale.

Il prototipo Butterscotch utilizza un display LCD con risoluzione 3K a occhio singolo e limita il campo visivo a circa la metà del casco Meta Quest 2 VR, quindi aggiunge un obiettivo personalizzato, che alla fine fa sì che il prototipo visualizzi un PPD di 55. Molto vicino al cosiddetto standard “Retina screen”.

Va notato che la potenza di calcolo non è un collo di bottiglia qui.La piattaforma Qualcomm Snapdragon XR2 utilizzata in Meta Quest 2 supporta già il display monoculare 3K. La difficoltà principale risiede nella contraddizione tra pannello del display, campo visivo, obiettivo e volume.

▲ Prototipo di caramello

Ovviamente, aumentare il PPD a 55 ha avuto anche un costo enorme per il prototipo Butterscotch, che aveva un campo visivo ristretto ed era incredibilmente ingombrante.

Prima di raggiungere la fine di un’esperienza metaverse a tutti gli effetti, possiamo esaminare dove si trova la tecnologia attuale: i dispositivi di visualizzazione Metaverse (spesso considerati prodotti VR) devono superare il Visual Turing Test, che richiede risoluzione, luminosità del display, zoom, magrezza e altro le dimensioni raggiungono un certo valore: ad esempio, il PPD raggiunge 60, la luminosità massima del display raggiunge i 20000 nits e così via.

Al momento, i prodotti consumer sono ancora molto lontani da questa soglia e i prototipi che possono soddisfare lo standard in un aspetto non possono tenere conto di altri obiettivi.

Fortunatamente conoscevamo gli obiettivi a lungo termine, li abbiamo scomposti, abbiamo costruito diversi prototipi e conoscevamo la direzione e le dimensioni di dove stavamo andando.

Non è questo più vicino a ciò che significa veramente “progresso” che semplicemente raffigurare una scena del metaverso?

Qual è il progresso della VR consumer?

Un produttore cinese ha appena fatto un piccolo passo nei prodotti VR di consumo.

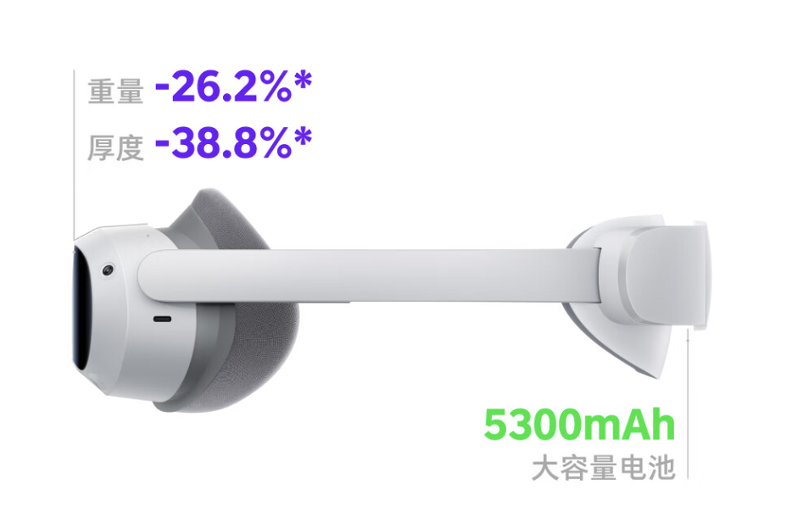

Pico ha recentemente rilasciato una nuova generazione di prodotti della serie VR Pico 4 e Pico 4 Pro. Il principale punto di forza dei nuovi prodotti è l’uso di lenti Pancake sviluppate internamente, che rendono Pico 4 più sottile e leggero. Rispetto al Pico neo 3 della generazione precedente, il Pico 4 è il 26,2% più leggero e il 38,8% più sottile, mentre la capacità della batteria non è ridotta.

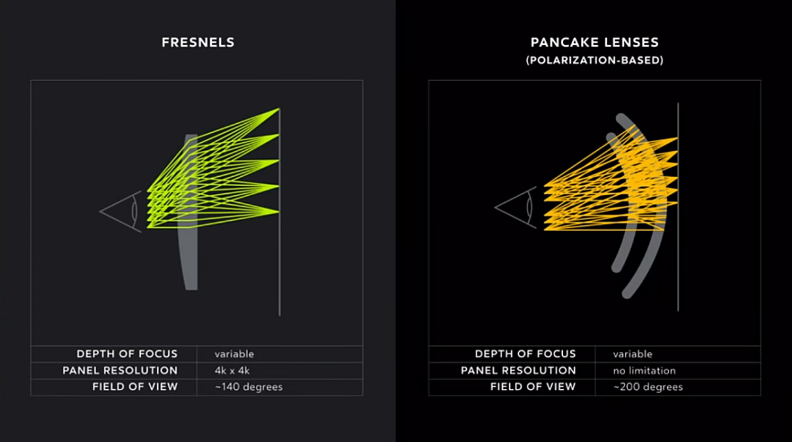

Rispetto alle tradizionali soluzioni di lenti asferiche e di Fresnel, lo spessore del modulo ottico della lente Pancake si riduce della metà (circa 2 cm).Inoltre, poiché questa soluzione utilizza due o più lenti, può ottenere la regolazione diottrica (miopia). può evitare di indossare gli occhiali) e migliorare la qualità dell’immagine dei bordi.

▲ Differenza tra la lente di Fresnel e lo schema della lente Pancake

Naturalmente, la struttura della lente Pancake sarà più complicata e il costo sarà maggiore.

Oltre ad essere molto sottile e leggero, controllando il peso a 295 grammi, gli altri due evidenti miglioramenti di Pico 4 sono la prospettiva del colore ad alta definizione e l’interazione a mani nude.

A mio parere, queste due nuove funzionalità sono le due porte per i prodotti VR verso il metaverso.

Dopo aver indossato i primi prodotti per la realtà virtuale, erano praticamente isolati dal mondo, potevano solo essere immersi nel mondo virtuale e se volevano connettersi con il mondo reale dovevano togliersi il casco.

Successivamente, abbiamo installato una telecamera in bianco e nero sul casco VR e, riprendendo l’ambiente esterno e visualizzandolo sullo schermo VR, facci sapere com’è l’esterno del casco, ma la maggior parte di questi prodotti sono in prospettiva in bianco e nero , e l’effetto è molto scarso.

La prospettiva del colore ad alta definizione, infatti, trasforma essenzialmente i prodotti VR in prodotti XR.

Il mondo virtuale e il mondo reale non sono più separati nei visori VR, ma hanno la possibilità di integrazione.

Per quanto riguarda l’interazione a mani nude, fornisce anche un metodo di interazione più naturale e naturale sull’interazione con la maniglia esistente. Dopotutto, niente è più flessibile delle nostre mani e l’interazione più ideale nel metaverso maturo non è sicuramente la tastiera e mouse., il touch screen, ma le nostre mani.

È interessante notare che le due nuove funzioni della prospettiva del colore ad alta definizione e dell’interazione a mano nuda si basano effettivamente sul supporto del Qualcomm Snapdragon XR2, il che dimostra ancora una volta che il Metaverse dipende anche molto dalla cooperazione industriale.

Come si relaziona il 5G con il Metaverso?

Abbiamo parlato prima dei prodotti di Meta e Pico, più del progresso dei dispositivi e delle interazioni nell’architettura del metaverse, e poi della rete.

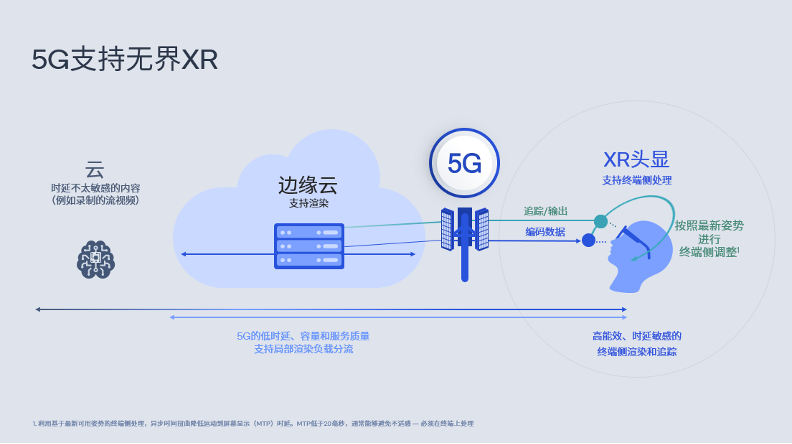

Alla conferenza mondiale sull’intelligenza artificiale (WAIC) appena conclusa, Qualcomm ha dimostrato una tecnologia chiamata “la prima tecnologia di rendering di separazione XR collaborativa end-to-edge del settore basata su sezioni 5G per migliorare la nuova esperienza di XR illimitato”.

È un boccone da leggere e sembra complicato, ma è anche molto significativo.

In passato, i prodotti VR non potevano calcolare da soli e dovevano essere collegati al PC con un cavo, ma poi c’era una macchina VR all-in-one; prima, i prodotti VR non avevano una funzione prospettica e non era chiaro com’era il mondo esterno, ma ora hanno la prospettiva dei colori; c’è una rete, purché sia supportato solo il Wi-Fi, significa che non possiamo indossare prodotti VR troppo lontani dal router.

Chiaramente, il 5G è un mondo più ampio e più libero.

“La prima tecnologia di rendering di separazione XR collaborativa end-to-edge del settore basata sullo slicing 5G migliora la nuova esperienza XR illimitata”.

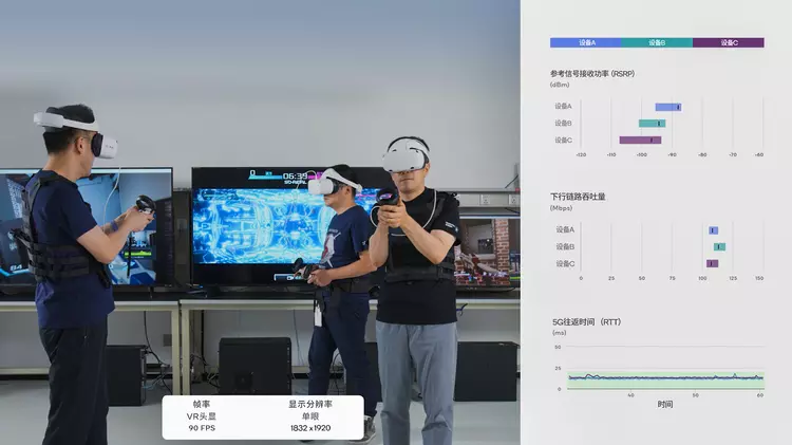

In questo test sono state utilizzate un totale di tre macchine all-in-one iQIYI Qiyu Dream Pro VR, uno smartphone Xiaomi che utilizzava la soluzione di slicing dei terminali di China Mobile e una piccola stazione base domestica 5G sviluppata da China Mobile Research Institute, Shiju e Gongjin. .

Sebbene 5G+VR sia una combinazione citata frequentemente, l’implementazione effettiva è ancora piuttosto difficile. Nel test, tutti e tre i lettori VR hanno ottenuto uno schermo di rendering in tempo reale con risoluzione 1832×1920, 90 FPS VR, che richiede una larghezza di banda piuttosto elevata. Tuttavia, perché della tecnologia di slicing della rete 5G, ogni giocatore può ottenere una velocità di downlink di 100 Mbps. Anche se la risoluzione del display dei futuri prodotti VR è maggiore e la frequenza di aggiornamento è più veloce, questa velocità è comunque ridondante.

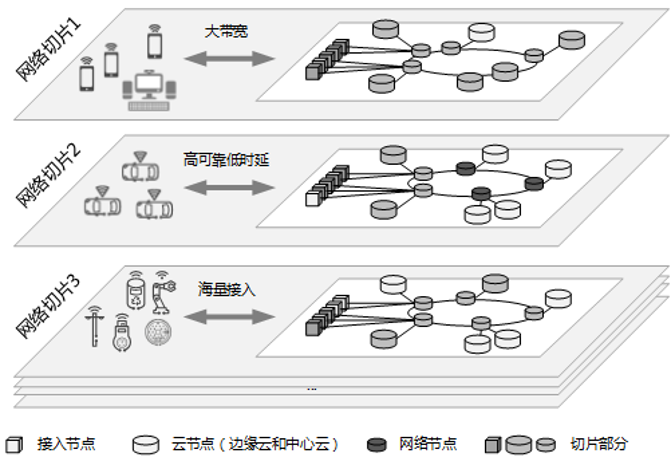

Ecco una spiegazione di cos’è lo slicing della rete 5G, perché nell’era del 5G, vari dispositivi e servizi hanno requisiti di rete diversi, come case intelligenti, monitoraggio ambientale e agricoltura intelligente.I requisiti sono connessioni massicce di dispositivi e volume di dati basso ma elevato frequenza video 4K, VR, trasmissione dal vivo e giochi su cloud richiedono maggiore larghezza di banda e velocità; servizi come Internet of Vehicles, reti intelligenti e controllo industriale richiedono una latenza di livello di millisecondi e un’affidabilità quasi del 100%.

Attraverso lo slicing della rete, gli operatori possono costruire più reti logiche dedicate, virtualizzate e isolate su una rete fisica comune per soddisfare i requisiti differenziati di diversi clienti per le capacità di rete.

Oltre a utilizzare lo slicing della rete 5G per garantire la velocità della larghezza di banda dei giochi VR, il test di Qualcomm di questa tecnologia è più importante per il “rendering di separazione collaborativo end-edge”.

L’estremità si riferisce all’estremità del prodotto VR e l’edge si riferisce all’edge cloud.In questo test, Qualcomm ha realizzato la distribuzione parziale del carico di rendering dell’edge cloud e ha consegnato la maggiore potenza di calcolo all’edge cloud per l’elaborazione, che è equivalente per rendere il dispositivo VR più potente. B.

È ipotizzabile che questa tecnologia possa ridurre ulteriormente il consumo di energia e la generazione di calore delle apparecchiature XR, riducendo le dimensioni e il peso del prodotto e migliorando il comfort.

Alla luce di ciò, credo che molte persone sentiranno la complessità delle varie tecnologie nel metaverso: hardware, informatica, rete, piattaforma, interazione e contenuto non sono isolati l’uno dall’altro, ma intrecciati.

Ad esempio, sembra che la tecnologia del 5G Unbounded XR di Qualcomm riguardi la rete, ma in realtà il core è migliorare la potenza di calcolo del dispositivo; e il cambiamento nell’interazione di Pico 4 è dovuto al progresso della tecnologia hardware.

È proprio a causa della complessità e della natura lungimirante del Metaverso che oltre ai produttori di dispositivi terminali (e contributori di contenuti) come Meta e Pico, anche società di infrastrutture come Qualcomm e Unity sono tenute a delineare l’informatica di base e la rete sostegno.

Molti dei suddetti dispositivi VR, come Meta Quest 2, Pico 4 e Qiyu Dream Pro VR all-in-one, utilizzano tutti la piattaforma Snapdragon XR2 di Qualcomm. Infatti, proprio come il SoC della serie Snapdragon 8 è sempre stata la prima scelta per i telefoni di punta, Qualcomm Snapdragon XR2 è anche la piattaforma informatica preferita dai dispositivi VR di fascia alta.

Il motivo per cui si dice che sia una piattaforma, non un processore, è perché i requisiti del Metaverse sono troppo complicati.Oltre al miglioramento delle prestazioni di CPU e GPU, possiamo anche dare un’occhiata alle caratteristiche del Metaverse del Piattaforma Snapdragon XR2 5G:

- Ha un processore di visione artificiale dedicato, può supportare sette telecamere parallele e supporta il pass-through della telecamera a bassa latenza;

- In termini di elaborazione della grafica 3D, la piattaforma XR2 5G ha 5 volte la velocità di ombreggiatura dei pixel, 1,5 volte la velocità di riempimento dei pixel e 3 volte la velocità di riempimento della trama rispetto alla generazione precedente;

- Il rendering della messa a fuoco visiva che supporta il tracciamento degli occhi e una singola risoluzione dell’occhio può raggiungere un’elevata frequenza di aggiornamento di 90 Hz a 3K × 3K

- Supporta video 8K a 60 fps, 4K a 120 fps, HDR10/HDR10+

- Supporta il tracciamento dell’osso della mano a 26 punti, suono spaziale 3D

- Con il modem Snapdragon X55 e il sistema RF, può fornire una velocità di downlink fino a 7 Gbps e una velocità di uplink di 3 Gbps

In una certa misura, queste caratteristiche possono a loro volta permetterci di comprendere le esigenze del metaverso per l’hardware, l’interazione e la rete, e anche aiutarci a capire, display VR a livello di retina, effetti sonori spaziali reali sul posto, nudi -interazione della mano, prospettiva del colore, su cosa si basano le tecnologie e le funzioni come il rendering della separazione end-to-edge nella rete 5G?

L’emergere del concetto di metaverso non è solo la partecipazione di grandi aziende, ma anche molte startup sono ansiose di provarci: dopo che un falso fuoco è svanito, l’industria si è effettivamente calmata un po’. All’inizio di quest’anno, Qualcomm ha annunciato l’istituzione dello Snapdragon Metaverse Fund, con un investimento di 100 milioni di dollari per assistere gli sviluppatori e le società collegate nella creazione di esperienze XR uniche e coinvolgenti, nonché relative tecnologie di realtà aumentata e intelligenza artificiale.

Qualcomm ha affermato che la fondazione, in collaborazione con Qualcomm Ventures, fornirà finanziamenti, attrezzature, tecnologia e assistenza di marketing alle principali società XR, inclusi gli sviluppatori che creano esperienze XR in aree come giochi, salute e benessere, media, intrattenimento, istruzione e commercio.

Allo stesso tempo, anche le già citate Meta e Pico hanno mantenuto la collaborazione con Qualcomm per realizzare innovazioni software e hardware in ambito XR.

Rispetto alla forte concorrenza nel mercato maturo dell’elettronica di consumo, attualmente nell’industria del Metaverse, tutti sono ancora per lo più cooperativi, non solo svolgendo i propri compiti, ma anche lavorando insieme in una struttura tecnica complessa. Ad esempio, Qualcomm ovviamente vuole ancora ricoprire il ruolo di guida o abilitatore, mentre la piattaforma Snapdragon si posiziona come la chiave per aprire le porte al Metaverse.

Nel complesso, dal punto di vista del progresso tecnologico e dell’implementazione, nel 2022 ci saranno molte nuove tendenze nel metaverso che meritano un applauso, infatti molte aziende stanno ancora lavorando alacremente per rendere meno vuoto il metaverso virtuale.

#Benvenuto a prestare attenzione all’account WeChat ufficiale di Aifaner: Aifaner (WeChat: ifanr), contenuti più eccitanti ti verranno forniti il prima possibile.

Love Faner | Link originale · Visualizza commenti · Sina Weibo