Dopo la fondazione di OpenAI: sogni, disaccordi e AGI

Nota dell'editore: quando Sam Altman ha elaborato la visione di OpenAI, ha affermato senza esitazione che vogliono sviluppare l'AGI (Artificial General Intelligence) che sia vantaggiosa e sicura per tutta l'umanità.

Con l'iniezione di capitale di Microsoft, molte persone hanno iniziato a dubitare di questo: OpenAI può davvero farlo?

Di fronte a questa domanda, Sam Altman ha dato una risposta affermativa.

Bloomberg ha recentemente creato una serie di podcast di quattro episodi, "Foundering: The OpenAI Story", che documenta l'ascesa di Sam Altman nel tentativo di comprendere appieno uno dei fondatori più importanti del nostro tempo.

Oggi traduciamo il secondo episodio di questa serie di podcast. Include quanto segue:

La natura multiforme dell'AGI: fare di tutto per creare l'AGI è considerata una visione importante da OpenAI. Ciò potrebbe risolvere molte sfide globali, ma pone anche rischi senza precedenti, tra cui un’intelligenza artificiale incontrollabile e gravi impatti sociali.

L'evoluzione di OpenAI: dall'innovazione basata sui dati alla condivisione attenta dei modelli. In che modo OpenAI rimane "aperto" nonostante i fattori commerciali?

Lotta di potere in OpenAI: il desiderio di Elon Musk per un maggiore controllo ha creato disaccordi con alcuni dipendenti di OpenAI. Sotto la guida di Sam Altman, OpenAI è passata da no-profit a for-profit.

Collegamento al podcast originale:

Voglio iniziare con un sogno, il sogno di costruire l'intelligenza artificiale.

Questo sogno è stato immaginato e scritto per decenni, poiché l’umanità lavora insieme per creare una nuova entità più potente di noi stessi. Alcuni ricercatori ritengono che questo sogno potrebbe presto diventare realtà.

Un giorno, i cervelli digitali che risiedono nei nostri computer saranno altrettanto validi, se non migliori, dei nostri cervelli biologici. I computer diventeranno più intelligenti di noi. Chiamiamo questa intelligenza generale artificiale (AGI).

Lo dice Ilya Sutskever, uno dei cofondatori di OpenAI. In un Ted Talk dell’anno scorso, si è spesso comportato come un mistico religioso quando parlava del futuro dell’intelligenza artificiale.

Ma ora parla solo della ricerca dell'AGI, un tipo di intelligenza artificiale in grado di pensare e risolvere problemi come gli umani. Può passare liberamente dal gioco, alla risoluzione di problemi scientifici, alla creazione di bellissime opere d'arte e alla guida di automobili.

L'obiettivo di OpenAI è costruire AGI. Nel mondo dell’intelligenza artificiale questa idea era molto all’avanguardia, almeno lo era. Ilya descrive l’AGI come un balzo in avanti quasi mistico e epocale, come Prometeo che porta il fuoco, con conseguenze enormi. Ci condurrà alla gloria tecnologica, ma anche al caos. Nel documentario "iHuman" ha espresso fiducia nei cambiamenti futuri.

L’emergere dell’intelligenza artificiale è una grande cosa adesso, perché l’intelligenza artificiale risolverà tutti i problemi che affrontiamo oggi. Si occuperà di occupazione, malattie e povertà. Ma porterà anche nuovi problemi. Il problema delle fake news diventerà più serio, gli attacchi informatici diventeranno più estremi e avremo armi IA completamente automatizzate.

Ilya è un ricercatore di intelligenza artificiale di grande talento che ha lavorato presso Google prima di unirsi a OpenAI. Ha un affetto profondo e appassionato per l'umanità. Sa suonare il pianoforte e disegnare. Uno dei suoi dipinti è appeso nell'ufficio di OpenAI. È un fiore a forma di logo dell'azienda.

Allo stesso tempo, è anche molto concentrato sulla ricerca sull’intelligenza artificiale. Una volta disse a un giornalista: "Vivo una vita molto semplice. Vado al lavoro e poi torno a casa. Non faccio nient'altro. Ci sono molte situazioni sociali in cui andare e molte attività a cui andare, ma non lo faccio." non parteciparvi."

Trascorre molto tempo osservando la traiettoria dell'intelligenza artificiale e cercando di prevedere il futuro. Ilya è particolarmente preoccupata se l’AGI avrà i propri desideri e obiettivi. Questa fantasia può essere ascoltata nelle sue parole.

Non è che odierà attivamente gli umani e vorrà far loro del male, ma diventerà troppo potente. Penso che una buona analogia sia il modo in cui gli esseri umani trattano gli animali. Non odiamo gli animali, ma quando dobbiamo costruire un'autostrada tra due città non li consultiamo. È concepibile che la superficie terrestre possa essere ricoperta di pannelli solari e data center.

Voglio fermarmi qui per un momento, questo presenta un'immagine molto forte e potente che stiamo creando una sorta di nuova esistenza. Sarà interessato a noi, ma alla fine indifferente, proprio come lo siamo con i cervi.

Ciò che mi ha colpito di più in questa registrazione è stato il tono di Ilya, che non era paura, ma stupore. Ilya immagina un'AGI che potrebbe ribaltarci per raggiungere i suoi obiettivi, uno scenario drammatico che è difficile da immaginare veramente. Questa concezione di un'entità soprannaturale e onnipotente ha una forte connotazione religiosa.

Devo dire che tutto questo è del tutto teorico e che siamo ancora lontani dall'AGI. OpenAI sta attualmente facendo del suo meglio per sviluppare modelli che possano imitare in modo credibile gli esseri umani, ma c’è ancora un grande divario tra l’imitazione e l’intelligenza artificiale in grado di pensare in modo indipendente. Tuttavia, OpenAI vuole farlo e vuole essere il migliore ed essere il primo. Ecco cosa ha detto Sam Altman durante la testimonianza davanti al Congresso nel 2023:

La mia più grande preoccupazione è l’enorme impatto che avremo sul mondo. Il nostro intero campo, la nostra tecnologia e la nostra industria possono causare “danni significativi” al mondo. Ecco perché abbiamo fondato questa azienda. Penso che se qualcosa andasse storto con questa tecnologia, potrebbe andare "terribilmente storto".

Stai ascoltando "Foundering" e io sono la tua ospite Ellen Hewitt. In questo episodio ti portiamo nei primi giorni caotici e idealistici di OpenAI.

Discutiamo del sogno di costruire un’AGI onnipotente, che è importante. Perché questo è ciò verso cui OpenAI sta rapidamente avanzando, la corsa alla luna di questa generazione. Discuteremo di come la tecnologia dell'intelligenza artificiale sta cambiando in modo drammatico e rapido e di come questo cambiamento stia avvicinando più che mai il sogno dell'AGI.

In pochi anni si è trasformata da un'idea curiosa e derisa a un traguardo che alcuni esperti ritengono possa essere raggiunto nel giro di pochi anni. Sam Altman ha addirittura suggerito che ciò potrebbe accadere nel 2028. Esamineremo anche i compromessi che OpenAI ha fatto nel perseguire questo sogno.

Inizialmente, la società aveva promesso di condividere ampiamente la propria ricerca e di non lasciarsi corrompere dalla motivazione del profitto. Ma quando la loro tecnologia cominciò ad avanzare e sembrava che avrebbero potuto acquisire un grande potere, fecero un’inversione di rotta. Questo momento critico si è poi trasformato in una lotta di potere all’interno di OpenAI, con Sam Altman a prendere le redini.

Cominciamo dal 2015. OpenAI era appena stata fondata in quel periodo, con un impegno di 1 miliardo di dollari da parte di Elon Musk, oltre a fondi di altri donatori. Era un piccolo laboratorio di ricerca alle prime armi.

All'inizio, Sam ed Elon non erano in giro molto spesso. All’epoca, Sam gestiva ancora l’acceleratore di startup Y Combinator, ma stava iniziando a posizionarsi come leader di pensiero nel campo dell’intelligenza artificiale. In particolare, si riferiva agli scenari apocalittici dell’IA.

Nel 2015, ha dichiarato in un blog che lo sviluppo dell’intelligenza artificiale sovrumana potrebbe rappresentare la più grande minaccia per la sopravvivenza dell’umanità. Ha anche scritto che l'intelligenza artificiale potrebbe distruggere ogni essere umano nell'universo. Nello stesso anno, in un evento tecnologico, ha accennato alla prossima nascita di OpenAI.

In effetti, ho appena accettato di finanziare un'azienda che fa ricerca sulla sicurezza dell'intelligenza artificiale. Sai, penso che l'intelligenza artificiale probabilmente causerà la fine del mondo. Ma nel frattempo ci saranno alcune grandi aziende che utilizzeranno tecniche avanzate di machine learning.

Voglio parlare di questa citazione. Dice che l’intelligenza artificiale potrebbe ucciderci tutti mentre ci chiede di fidarci delle sue conclusioni come esperto. Ma è anche "disinvolto" quando si tratta di fare soldi.

Agli albori di OpenAI, Sam ed Elon non erano spesso coinvolti nel lavoro quotidiano. Escono e parlano con la gente, reclutano talenti, parlano con i giornalisti. Vengono circa una volta alla settimana per aggiornamenti sui progressi. In quei giorni, Sam entrava nella conversazione e poi se ne andava.

Mi sembra molto intelligente, acuto e molto efficiente. Quando la conversazione è finita, è finita.

Si tratta di Peter Abele, un ricercatore che ha lavorato presso OpenAI nei suoi primi due anni. All’inizio OpenAI sembrava una tipica startup, ha detto. Per un po’ non ebbero nemmeno un ufficio e si incontrarono a casa di uno dei cofondatori.

Abbiamo iniziato a lavorare nell'appartamento di Greg Brockman nel Mission District di San Francisco tra la fine del 2015 e l'inizio del 2016. Fondamentalmente ci sediamo sul divano, sul bancone della cucina e sul letto, ed è lì che avviene il lavoro. È pazzesco immaginare che un progetto così grande possa iniziare qui. Abbiamo 20 dei migliori ricercatori di intelligenza artificiale al mondo concentrati sulla realizzazione di qualcosa che non è mai stato fatto prima.

In assenza di Sam ed Elon, i principali leader erano due uomini che in seguito avrebbero ricoperto ruoli importanti. Non sono celebrità ma giocheranno un ruolo enorme in futuro.

Uno è Greg, il cui appartamento funge da ufficio, e l'altro è Ilya, lo scienziato dell'intelligenza artificiale di cui abbiamo sentito parlare all'inizio dell'episodio. Puoi pensare a Greg come al maniaco del lavoro responsabile delle operazioni aziendali e a Ilya come al genio dell'intelligenza artificiale.

Insieme gestivano OpenAI e Peter ricordava di aver camminato per le strade di San Francisco con Ilya ogni settimana, parlando del quadro generale e chiedendosi: stiamo risolvendo il problema giusto?

Penso che abbia visto il potenziale dell’intelligenza artificiale prima e più chiaramente di chiunque altro. Era più ottimista degli altri e trovava delle analogie. Ad esempio, una rete neurale è solo un programma per computer, solo un circuito, noi lo programmiamo semplicemente in un modo diverso.

Nel frattempo, Greg continuava a lavorare sodo.

Greg è il tipo di persona che mette anima e cuore nel suo lavoro. Potrebbe continuare a lavorare e lavorare. Di persone così ne ho viste, ma molto poche.

Anche dopo che OpenAI si è trasferita dall'appartamento di Greg, lui ha continuato a vivere praticamente in ufficio. Un ex dipendente ha detto che stava ancora lavorando alla sua scrivania quando arrivavano al lavoro la mattina e stava ancora digitando sulla tastiera quando uscivano la sera.

Quando Greg si sposò qualche anno dopo, tenne addirittura una cerimonia laica in ufficio. Decorato con un grande sfondo floreale, la forma del fiore è anche il logo OpenAI. L'anello era tenuto da una mano robotica e l'officiante del matrimonio era Ilya.

Quando Greg e Ilya si sono uniti a OpenAI, non avevano bisogno di soldi. Ilya vendette un'azienda a Google e Greg possedeva gran parte di Stripe, che valeva decine di miliardi di dollari.

Nella Silicon Valley, la ragione abituale per cui le persone avviano una startup è perché pensano di poter costruire un business redditizio. Ma OpenAI è un'organizzazione senza scopo di lucro. Greg e Ilya sono stati ispirati da questo sogno.

Questo è Reid Hoffman, uno dei primi donatori di OpenAI:

Non è previsto alcun rendimento azionario per la squadra iniziale. Lo fanno per l'umanità.

"Questo è per l'umanità", ha sempre detto OpenAI. Il loro sito web afferma che la nostra missione è garantire che l’AGI vada a beneficio di tutta l’umanità.

Beh, non è un segreto che la Silicon Valley ami le grandi dichiarazioni di missione e WeWork vuole promuovere la consapevolezza globale, ma la dichiarazione di intenti di OpenAI è ancora più grandiosa, con sfumature di altruismo.

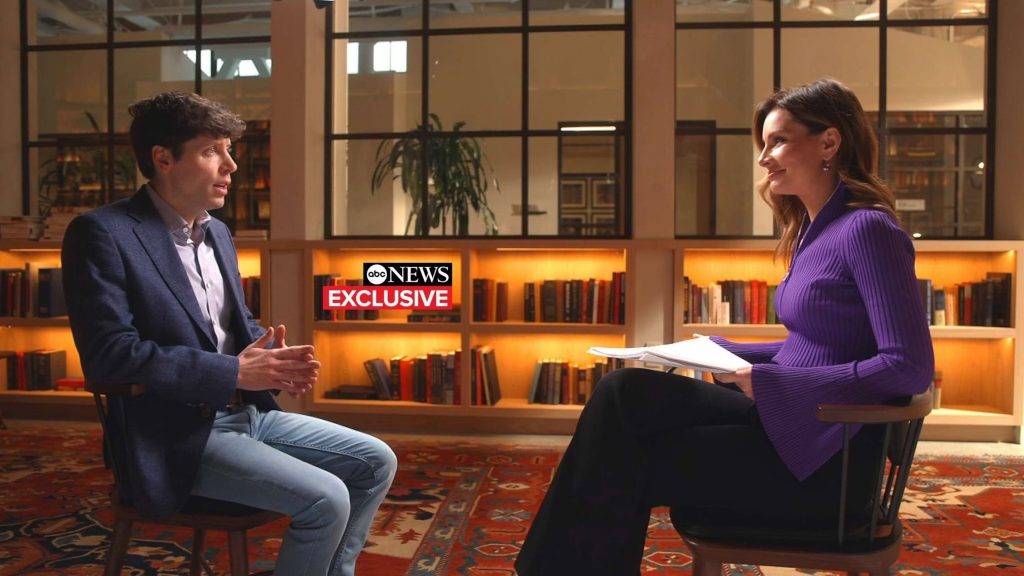

Quando Sam parla del lavoro dell'azienda, spesso parla di potenziali disastri. Qui parla con Rebecca Jarvis della ABC, con voce di nuovo seria mentre si posiziona come leader di pensiero nel campo. Quindi, qual è il risultato peggiore?

Sam Altman: Una cosa che mi preoccupa particolarmente è che questi modelli potrebbero essere utilizzati per disinformazione su larga scala. Ora che stanno migliorando nella scrittura di codici informatici, temo che questi sistemi possano essere utilizzati per attacchi informatici offensivi.

Rebecca Jarvis: Lei sottolinea un punto importante, ovvero che anche gli esseri umani che controllano le macchine ora hanno un potere enorme.

Sam Altman: Siamo molto preoccupati per i governi autoritari che sviluppano questa tecnologia.

Rebecca Jarvis: Putin una volta disse che chiunque vinca questa corsa all'intelligenza artificiale controllerà sostanzialmente l'umanità. Sei d'accordo con questa affermazione?

Sam Altman: Questa è davvero un'affermazione agghiacciante.

Sam dice che questa cosa è così preziosa che le superpotenze globali combatteranno per averla. Gli scettici credono che se fai sembrare che ciò su cui stai lavorando sia importante, attirerai più attenzione e finanziamenti. Ci concentreremo su questa prospettiva nella prossima puntata.

Agli albori di OpenAI, i piani per salvare l’umanità non erano chiari. La loro strategia era un po' frammentaria, ecco il ricordo di Peter:

Abbiamo esaminato la robotica, dove abbiamo effettuato alcune esplorazioni; abbiamo esaminato i robot analogici, dove abbiamo trascorso molta esperienza e abbiamo esaminato gli agenti digitali che possono eseguire vari compiti sul web; come prenotare i voli. Abbiamo considerato anche i videogiochi.

OpenAI afferma che uno dei suoi primi obiettivi sarà quello di costruire un maggiordomo robot in grado di apparecchiare e sparecchiare i tavoli. Come la cameriera dei Jetsons.

L'azienda ha anche costruito una mano robotica in grado di risolvere il cubo di Rubik con una sola mano, e si è impegnata molto nello sviluppo di un robot in grado di giocare a Dota 2, un gioco online multiplayer estremamente popolare. Credono che la complessità dell'ambiente di gioco possa consentire all'intelligenza artificiale di navigare meglio nel mondo reale.

Ecco qualcuno che sta testando il bot:

Questo robot è fantastico, molto meglio di quanto mi aspettassi.

Questi robot Dota competono anche contro giocatori professionisti:

Preparati in anticipo, l'azione inizia! Quindi, l'IA ha preso la prima goccia di sangue…

Un bot in grado di giocare a Dota è tecnicamente impressionante, ma alla persona media non sembra così e le applicazioni commerciali di questi prodotti non sono immediatamente evidenti. Ecco il commento di un ex dipendente:

Stiamo facendo cose casuali e vediamo cosa succede. A volte sembra che ci sia un grande divario tra ciò che è stato costruito e ciò che è stato immaginato. Le persone programmano i robot per giocare ai videogiochi durante il giorno, e poi si siedono attorno al tavolo a pranzo parlando di salvare l’umanità.

Una visione comune nel campo dell’intelligenza artificiale è che per creare qualcosa di potente, a volte è necessario iniziare con qualcosa di banale. I videogiochi e le cameriere robot apriranno la strada alle auto a guida autonoma e all’intelligenza artificiale in grado di curare il cancro.

All'interno di OpenAI, a volte si paragonano al Progetto Manhattan, il team responsabile della costruzione della prima bomba atomica, e pensano che sia una cosa buona, ambiziosa e importante. Questo è quello che mi ha detto un altro ex dipendente:

È una corsa agli armamenti, tutti vogliono realizzare la prima AGI e pensano di poterlo fare al meglio. Non vedo molta paura riguardo all'intelligenza artificiale in sé, vedo solo entusiasmo per la costruzione dell'intelligenza artificiale.

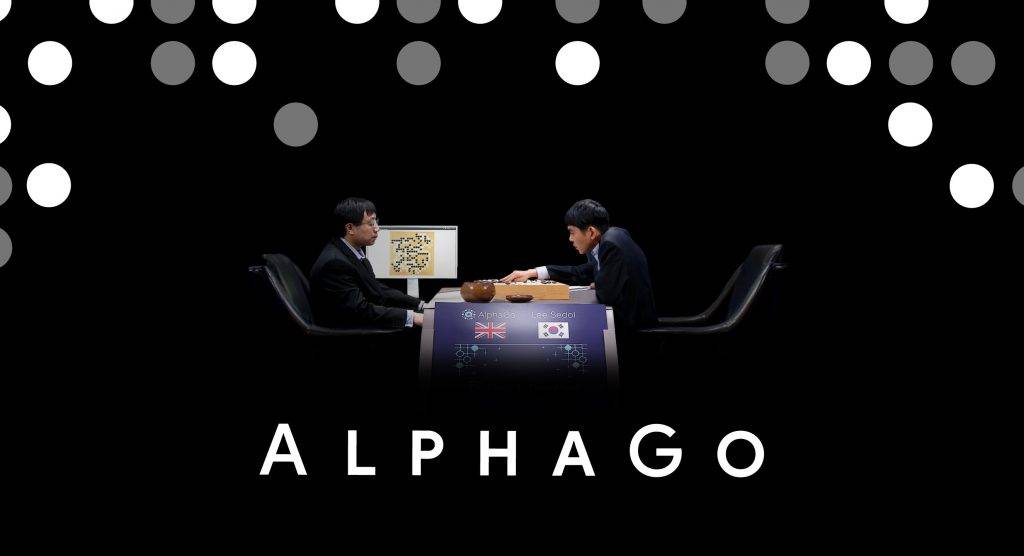

Nel 2015, l’intelligenza artificiale appariva molto diversa da oggi, era più debole e più difficile da addestrare. La grande svolta all'epoca fu che un robot riuscì a battere i migliori giocatori del mondo in Go, un complesso gioco da tavolo strategico proveniente dalla Cina. Ma quell'intelligenza artificiale può solo giocare a Go, non può fare nient'altro.

Questo è Oren Etzioni, professore di informatica ed ex direttore di ricerca di un istituto di ricerca sull'intelligenza artificiale:

Questi sistemi hanno un dominio ristretto e sono molto mirati. Il sistema che gioca a Go non può nemmeno giocare a scacchi, tanto meno attraversare la strada o capire una lingua. Inoltre, un sistema in grado di prevedere le fluttuazioni dei prezzi dei biglietti aerei e di prevedere aumenti o diminuzioni dei prezzi dei biglietti aerei in modo molto accurato non è in grado di gestire il testo. Quindi, in sostanza, ogni volta che c'è una nuova applicazione, è necessario addestrare un nuovo sistema. Ciò richiede molto tempo, richiede molti dati annotati, ecc.

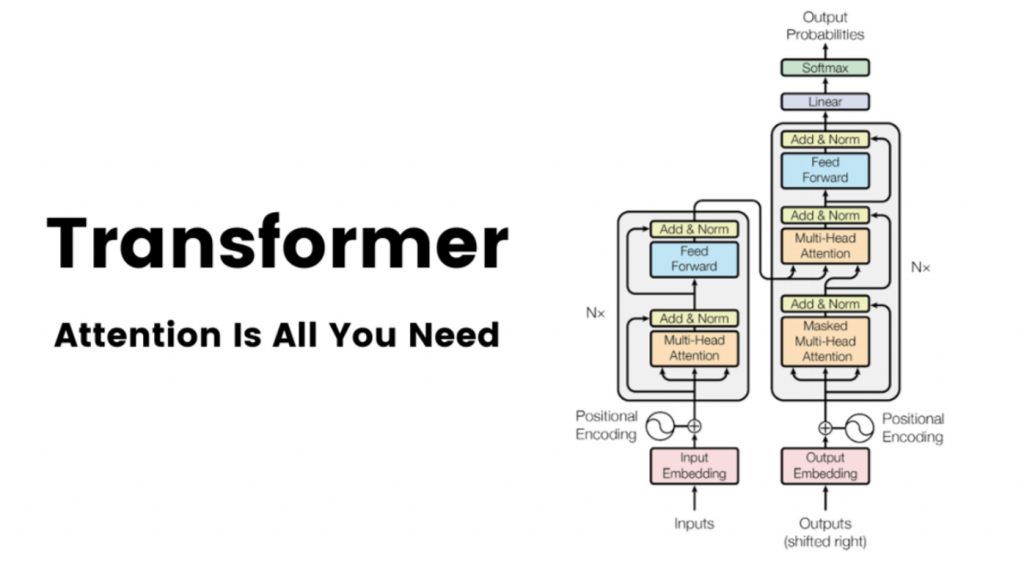

Ma poi, la tecnologia dell’intelligenza artificiale ha fatto un passo avanti importante. Nel 2017, un team di ricercatori di Google Brain ha pubblicato un articolo intitolato “L’attenzione è tutto ciò di cui hai bisogno”. In questo articolo descrivono una nuova architettura AI chiamata Transformer.

Transformer fece qualcosa di molto importante per i suoi tempi. Il sistema di intelligenza artificiale deve inserire dati molto specifici e ogni dato deve essere etichettato, questo è corretto, questo è sbagliato, questo è spam, non spam, questo è cancro, non cancro…;

Ma Transformer consente all’IA di ricevere dati disordinati e senza etichetta. In effetti, può farlo in modo più efficiente del previsto, utilizzando meno potenza di calcolo.

Ora, questi modelli basati su Transformer possono imparare da soli. È un po' come se volessi insegnare a leggere a un bambino, prima dovevi assumere un tutor che si sedesse lì e usasse le flashcard, ma ora puoi lasciare che il bambino vada in biblioteca da solo e ne uscirà sapendo come leggere e scrivere.

È una realtà sorprendente e dolorosa, come me l’ha descritta un investitore, che la migliore intelligenza artificiale non provenga dalle tecniche di formazione più specializzate, ma da quelle con più dati.

Peter, uno dei primi dipendenti di OpenAI, afferma che Ilya ne ha subito visto il potenziale:

Ilya ha reagito con certezza, dicendo che si trattava di un importante passo avanti a cui dovevamo prestare attenzione.

Anche agli albori di OpenAI, Ilya ha sempre avuto la sensazione che i maggiori progressi nell’intelligenza artificiale non sarebbero arrivati da un particolare aggiustamento o da una nuova invenzione, ma da più dati, che avrebbero versato sempre più carburante nel motore. Ora Ilya ha delle ricerche a sostegno della sua ipotesi.

Questo è ciò che Oren ha detto ancora:

Ilya di OpenAI è noto per la sua convinzione secondo cui i dati e il loro volume, se li aumentiamo in modo significativo, ci porteranno dove dobbiamo essere. Questa non è una credenza comune e molte persone molto intelligenti e famose, me compreso, non lo avevano previsto.

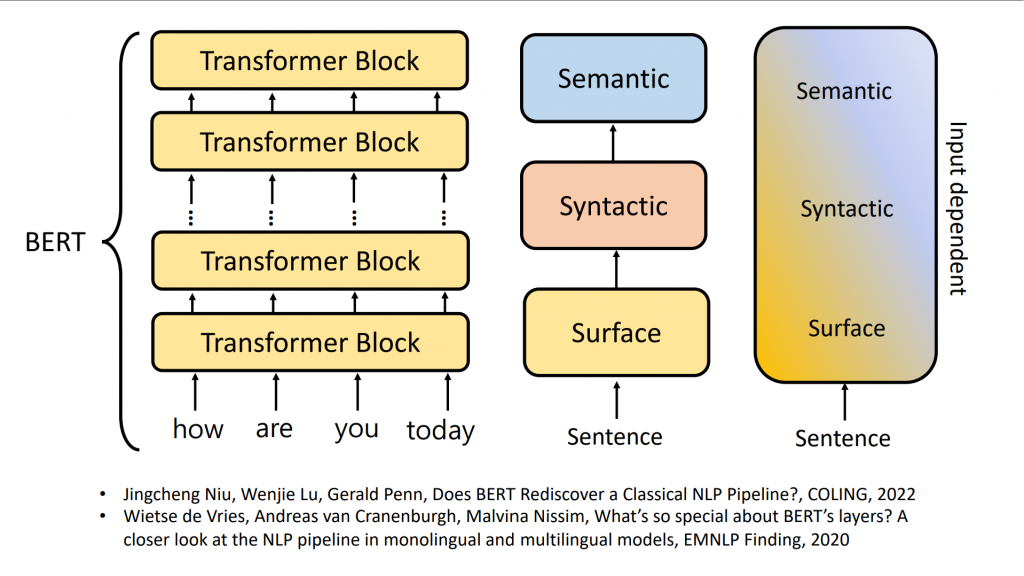

Grazie alla spinta di Ilya, OpenAI ha iniziato a sperimentare Transformer. Sono state una delle prime aziende a farlo. Hanno realizzato il modello che genera Transformers pre-addestrati con l'ormai familiare acronimo GPT.

Soprattutto quando hanno iniziato a sperimentare le prestazioni del Transformer durante l'elaborazione del testo. Perché possono praticamente digitare qualsiasi libro, articolo di giornale, post su Reddit, blog. Gli esseri umani trascorrono molto tempo a scrivere e quel testo ora ha un nuovo scopo: addestrare i dati.

Internet non è stato creato per addestrare l’intelligenza artificiale, ma alla fine questa potrebbe essere la sua eredità. I modelli di OpenAI stanno migliorando nella generazione di testo e non solo in un dominio della conoscenza.

La cosa sorprendente dei sistemi GPT è che sono così ampi da essere in realtà generalisti. Puoi fare loro domande su quasi tutti gli argomenti e ti daranno risposte sorprendentemente buone. Questo perché sono stati addestrati per avere effettivamente a disposizione degli esseri umani l'intero corpus di testi, miliardi di frasi, tutti i documenti, promemoria, curiosità, fan fiction di Harry Potter che abbiate mai letto, tutto questo viene immesso nel mulino. Una volta letto questo, diventa molto versatile. Quindi, per la prima volta abbiamo un sistema in cui puoi porre qualsiasi domanda e ti darà una risposta sorprendentemente intelligente, dall'IA di dominio ristretto a un'IA generale o ampia.

Inserendo grandi quantità di testo nel modello, OpenAI ha scoperto di poter creare un'intelligenza artificiale molto più efficace nel generare risposte convincenti. Infatti, ad un certo punto, hanno iniziato a preoccuparsi che potesse essere troppo bello.

Quando è emerso per la prima volta il modello linguistico GPT-2 di OpenAI, la loro decisione iniziale è stata quella di non condividere il modello in modo più ampio perché temevano che potesse essere pericoloso. Questo è Peter, che a quel punto aveva lasciato OpenAI e aveva fondato la propria azienda, ma ricorda la scena il giorno del lancio:

A quanto pare, capisce il linguaggio molto meglio di qualsiasi cosa su cui sia stato addestrato prima. Il suo rilascio è arrivato con molto, forse un buon marketing, forse cautela, o entrambi. È stato definito "troppo pericoloso per essere rilasciato", quindi penso che questo sia il primo progetto in cui OpenAI ha deciso di non rendere pubblica parte del suo lavoro. All'improvviso, la cosa a cui pensiamo diventa: "E se qualcosa fosse così potente che le persone potrebbero abusarne in modi che non possiamo controllare?"

Una volta che OpenAI avrà un prodotto davvero forte, inizieranno a ripensare la propria apertura.

Per il nome OpenAI, Open significa davvero che tutto sarà open source e chiunque potrà basarsi su di esso.

L'"apertura" è una componente chiave del marchio dell'azienda. Quando lo lanciarono, Sam disse al giornalista Steven Levy: "Sarà open source e chiunque potrà usarlo".

Ha anche detto ai giornalisti: "La loro intelligenza artificiale sarà di proprietà gratuita del mondo. Software open source, in generale, significa che il codice sorgente è pubblico e chiunque può modificare il codice e distribuirlo da solo". questi impegni.

Ovviamente, nel tempo questo è diventato qualcosa che non era del tutto open source, o addirittura open source. Voglio dire, sicuramente non renderanno open source il loro lavoro ora.

Questo spirito open source sembra stia lentamente scomparendo. Quello che segue è un discorso che Sam ha tenuto a Monaco nel 2023:

Sono curioso, se manteniamo la traiettoria di GPT-2, GPT-3, GPT-4 e poi verso GPT-5 e GPT-6, quante persone vogliono che diamo GPT-6 open source il giorno in cui completiamo la formazione? ?

Wow, okay, non lo faremo, ma è divertente.

Onestamente, Sam qui sembra piuttosto arrogante. Sapeva che OpenAI inizialmente prometteva di essere open source. Ora sta sondando il suo pubblico su cosa pensano del modello open source e poi respinge immediatamente le loro risposte.

Nel corso degli anni, Sam ha leggermente cambiato il significato di "aperto", diventando più ambiguo. Ecco cosa ha detto in una società di venture capital:

Questo è ciò che chiamiamo OpenAI e vogliamo che questa tecnologia sia aperta a tutti.

Lo disse in modo così naturale, come se fosse ovvio cosa significasse apertura. Ma la sua definizione mi sembra così vaga da risultare sostanzialmente priva di significato. Voglio dire, la ricerca su Google è aperta a tutti. Sembra che OpenAI sia felice di indurre le persone a indovinare cosa intendono per apertura.

Pochi mesi dopo la fondazione dell'azienda, Ilya scrisse in un'e-mail interna:

Man mano che ci avviciniamo alla costruzione dell’intelligenza artificiale, ha senso iniziare a diventare meno aperti. L'"Open" in OpenAI significa che tutti dovrebbero beneficiare dei risultati dell'IA, ma non è necessario condividere la scienza, anche se nel breve e possibilmente medio termine condividere tutto è sicuramente la giusta strategia per reclutare talenti.

Questa email è molto interessante perché mostra che fin dall'inizio OpenAI aveva pianificato di non condividere liberamente la propria scienza. Non vogliono essere open source come sostengono, ma vogliono mantenere un'immagine pubblica aperta perché dà loro un vantaggio in termini di reclutamento.

Ad esempio, non costruire l'intelligenza artificiale per i cattivi, vieni a lavorare per noi. Quando abbiamo chiesto informazioni sul cambiamento della loro definizione di apertura, un portavoce dell'azienda ha detto: "La nostra missione è rimasta la stessa, ma la nostra strategia ha dovuto cambiare".

Ok, torniamo al 2017. Due anni dopo la fondazione dell’azienda, in OpenAI è emerso un nuovo problema: una lotta per il potere.

Elon vuole subentrare, è il tipo di persona abituata a comandare. Secondo OpenAI, vuole trasferire l'azienda sotto Tesla e diventare CEO con una quota di maggioranza. Se le cose non vanno come vuole, se ne va.

Come per tutte le cose che riguardano Elon, col tempo vuole esercitare un maggiore controllo e assicurarsi che l'azienda sia gestita nell'immagine e nel modo in cui vuole che sia. Quindi questo crea tensione.

Questa è la mia collega Ashley Vance, che ha scritto una biografia su Elon.

Il ruolo preferito di Elon in qualsiasi cosa è quello di essere l'amministratore delegato e la forza dominante nel controllo delle operazioni quotidiane.

In effetti, Greg Brockman e Ilya Sutskever, responsabili delle operazioni quotidiane, sono molto vigili. Sebbene Elon sia spericolato, impulsivo e con cui è difficile andare d'accordo, è anche la loro principale fonte di finanziamento.

Ha promesso quasi 1 miliardo di dollari. OpenAI ha altri donatori, ma nessuno si avvicina a tale importo. Un’opzione è restare con Elon e mantenere il suo capitale.

I dipendenti non sono del tutto convinti dell’idea e hanno alcune preoccupazioni. Quindi siamo arrivati a questo punto decisionale: dovremmo restare con Elon o lasciarlo? Negli ultimi anni le persone hanno quasi sempre sopportato Elon e le sue richieste.

Oppure un’altra opzione è separarsi da Elon e trovare altre fonti di finanziamento. Conosci qualcuno che potrebbe essere bravo a raccogliere fondi? Sam Altmann.

L'obiettivo era che Elon volesse che l'azienda andasse in una direzione e che i dipendenti volessero andare in un'altra, quindi Sam è stato scelto per guidare OpenAI.

Nei primi anni Sam non era molto coinvolto in OpenAI. In realtà è ancora il presidente di Y Combinator, ma in questa lotta per il potere, Sam vince su Elon, e questo è un grosso problema. Elon è più famoso, più esperto e soprattutto odia perdere.

In un conflitto, la reazione di Elon è vincere a tutti i costi. Elon ha raramente perso una “battaglia” negli ultimi anni. In genere, se non è all'interno dell'azienda, farà causa a qualcuno per convincerlo a cedere; se è all'interno, perseguirà la politica finché non otterrà ciò che vuole; È difficile trovare un esempio negli ultimi anni in cui non abbia ottenuto i risultati che voleva. Quindi le turbolenze all'interno dell'azienda devono essere molto gravi affinché ciò non accada.

Così, nel 2018, Elon se ne andò portando con sé il suo capitale. Pochi anni dopo, avrebbe effettivamente fatto causa a Sam e OpenAI, sostenendo che avevano rinnegato le loro promesse originali di no-profit e open source.

Poco dopo la partenza di Elon, Sam è diventato CEO di OpenAI. Non c'era mai stato nessun CEO qui prima, ma la lotta per il potere ha definito il nuovo dominio di Sam nell'azienda. Ricordi cosa disse una volta il fondatore di YC? "Sam è molto bravo a essere potente."

L'interesse di Sam per OpenAI ha continuato a crescere e la sua attenzione ha iniziato a spostarsi dalla gestione di YC. In effetti, gestire un acceleratore di startup di fama mondiale è una posizione di grande impatto.

Ma la corsa per l’AGI si sta scaldando, e se OpenAI riuscisse a creare l’AGI prima di chiunque altro, sarebbe difficile immaginare una posizione con più potere del suo CEO. Tuttavia, Sam non ha lasciato subito il suo lavoro alla YC.

La situazione rende infelici alcune persone che gestiscono gli acceleratori. Sentivano che Sam era troppo distratto, spinto troppo in fretta e anteponeva i propri interessi a quelli di YC. Ciò gli ha creato alcuni nemici all'interno della sua stessa squadra.

Infatti, secondo una fonte, il mentore di Sam Paul Graham, l'uomo che originariamente lo aveva messo in quella posizione, volò dal Regno Unito per chiedere personalmente a Sam di dimettersi. Paul ha perso la fiducia nel suo ex protetto, ma non voleva nemmeno creare un dramma pubblico. Quindi Sam è stato convinto a lasciare, hanno mantenuto un profilo basso e ora si concentra solo su OpenAI.

Sam ha un grande obiettivo: raccogliere fondi per addestrare i modelli di OpenAI. Richiedono molta potenza di calcolo e la potenza di calcolo è costosa. Sam ha provato a raccogliere fondi ma non ha fatto progressi. Ecco cosa ha detto nel podcast di Lex Fridman:

Abbiamo iniziato come organizzazione no-profit. Abbiamo capito subito che avevamo bisogno di molti più soldi di quelli che potevamo raccogliere come organizzazione no-profit per fare ciò di cui avevamo bisogno. Abbiamo provato più volte a raccogliere fondi come organizzazione no-profit, senza riuscirci. Non vediamo una strada da seguire lì. Quindi abbiamo bisogno di alcuni dei benefici del capitalismo, ma non di troppi. Ricordo che qualcuno disse che come organizzazione no-profit le cose non sarebbero andate abbastanza lontano, come organizzazione a scopo di lucro le cose sarebbero andate troppo oltre.

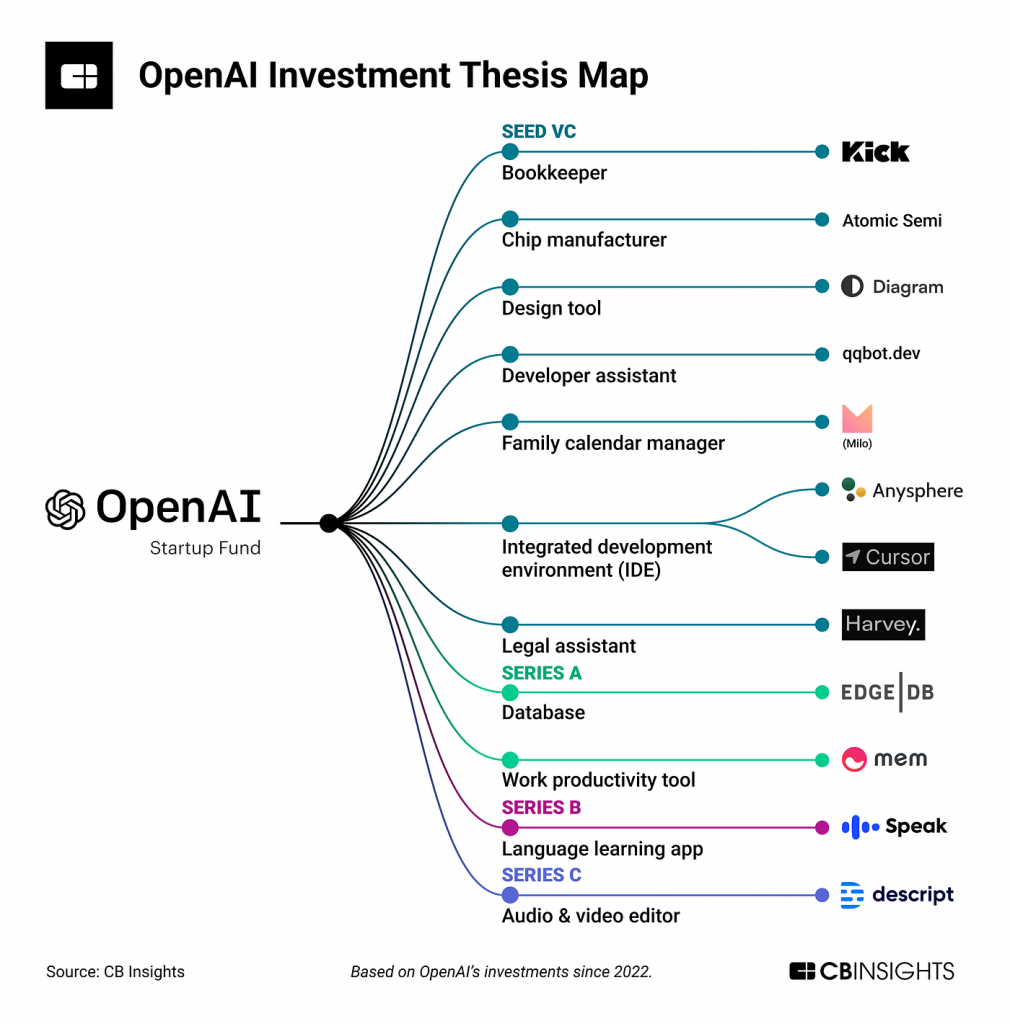

Avevano bisogno di una via di mezzo e, a dire il vero, Sam non era troppo preoccupato per la vita dopo il no-profit. Ha messo insieme qualcosa e fondamentalmente ha creato un'entità a scopo di lucro affiliata all'organizzazione no-profit originale.

Un’entità a scopo di lucro può fare tutto come una normale azienda, come raccogliere investimenti e fornire capitale ai dipendenti, ma i rendimenti per i suoi investitori sono limitati, mentre in altre società sono illimitati.

Questa struttura aziendale è stata messa insieme, con OpenAI ora essenzialmente un’entità a scopo di lucro controllata da un consiglio di amministrazione senza scopo di lucro, il che sembra un po’ traballante. OpenAI ha trascorso diversi anni sostenendo che sarebbe stata un'organizzazione no-profit e ora ha trovato questa soluzione a scopo di lucro.

Dopo quel cambiamento, molte persone erano infelici. Ma OpenAI è più focalizzato sul suo obiettivo finale, vuole costruire AGI e ha bisogno di raccogliere fondi per raggiungere questo obiettivo.

Poi, nel 2019, il trader Sam ha fatto un grosso affare: ha raccolto 1 miliardo di dollari da Microsoft. Quello che segue è ciò che ha detto il CEO di Microsoft Satya Nadella dopo la firma dell'accordo:

Ciao, sono qui con Sam Altman, CEO di OpenAI. Oggi siamo molto entusiasti di annunciare la nostra partnership strategica con OpenAI.

È importante sottolineare che Microsoft dispone di molta potenza di calcolo grezza che OpenAI può ora utilizzare. Ricorda, OpenAI è stato originariamente concepito come “antidoto” a Google. Si sono presentati come fondamentalmente diversi dai giganti della tecnologia affamati di profitto, e da un giorno all’altro sono diventati intimamente associati ad aziende tecnologiche che valgono più di un trilione di dollari.

OpenAI è ora per molti versi un fork di Microsoft, il che rappresenta un cambiamento significativo. Reid Hoffman, che all'epoca era nel consiglio di amministrazione sia di OpenAI che di Microsoft, non vide questo come un abbandono della promessa originale di OpenAI.

Si temeva che ciò avrebbe compromesso la missione. Ma penso che sia un’ingenuità moderna pensare che le aziende siano sinonimo di cattive o corrotte, perché ci sono tanti modi in cui le aziende interagiscono con gli esseri umani e la società. Cercano di servire i clienti, assumere dipendenti, avere azionisti ed esistere nella società.

Il punto di Reid è che voler fare soldi non significa essere cattivi, il che è tipico di un venture capitalist miliardario.

Ho la sensazione che l’accordo con Microsoft potrebbe essere il modo più pratico per OpenAI di continuare la sua missione di creare AGI sicure per tutta l’umanità. Ma evidenzia anche l'importante caratteristica che OpenAI tende a fare marcia indietro sulle sue promesse quando è conveniente.

Sotto questo aspetto, la gente cominciò a mettere in dubbio l'integrità di Sam, sia all'interno che all'esterno dell'azienda.

Ciò causerà una grossa crepa.

Ci vediamo al prossimo episodio di "Foundering"!

# Benvenuto per seguire l'account pubblico WeChat ufficiale di aifaner: aifaner (ID WeChat: ifanr) Ti verranno forniti contenuti più interessanti il prima possibile.

Ai Faner |. Link originale · Visualizza commenti · Sina Weibo