L’intelligenza artificiale sta cambiando il volto delle multinazionali defraudate di quasi 200 milioni, diffidare di queste nuove truffe

Nel nuovo anno e nella nuova atmosfera, oltre ad avere un buon rapporto con il Dio della ricchezza, è anche importante conservare la borsa dei soldi.

Il processo di implementazione della tecnologia è spesso la storia dell'evoluzione dei contenuti pornografici e delle routine di frode.

Approfittando del saldo residuo durante le vacanze, insegna ai tuoi anziani a diffidare delle nuove truffe dell'IA, così da poter raggiungere la "prosperità comune" del gruppo familiare della "famiglia amorevole".

Catturare molti blogger di intelligenza artificiale può ingannare le persone più del "falso Jin Dong"

In "Viaggio verso l'Ovest" si dice che gli umani nascono da umani e i demoni nascono da demoni. L'IA prodotta dal codice non ha genitori, ma vuole fingere di essere in carne ed ossa per farla fraintendere come un essere umano.

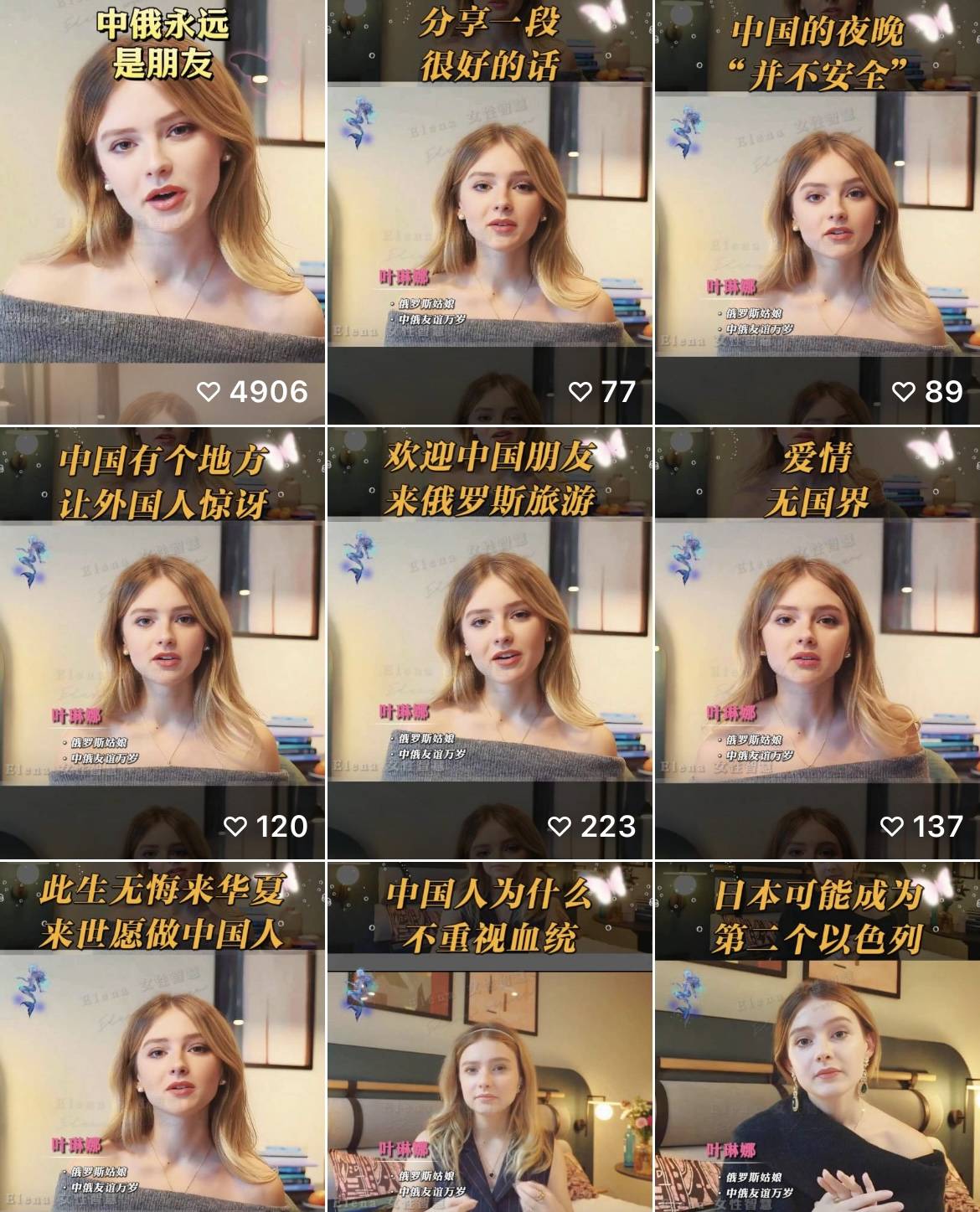

Recentemente, molte "bellezze russe" sono apparse sugli account video. Hanno tutti la pelle chiara e sono belli, e il loro mandarino è fluente, ma la frammentazione e la pronuncia delle frasi sono strane e le loro intonazioni e suoni nasali sono difficili da pronunciare. Naturalmente, considerando il loro status straniero, sarebbe naturale avere un accento.

Sono entusiasti e amano la cultura cinese. Hanno etichettato il video con etichette come "Ragazze russe in Cina" e "Amicizia sino-russa", e hanno portato agli spettatori "specialità della loro città natale" come salsiccia di tendini di manzo, costolette, latte di capra in polvere, e cetrioli sottaceto. , cioccolato, sapone fatto a mano.

Hanno sopracciglia che sembrano accigliate ma non accigliate, e occhi che sembrano felici ma non felici. Oltre a portare beni, esprimono anche le loro opinioni. Credono che l'amore non conosca confini e credono che la semplicità sia la cosa giusta. verità. Si lamentano della prosperità qui e vogliono sposare i loro genitori e la sorella. Anche loro sviluppati.

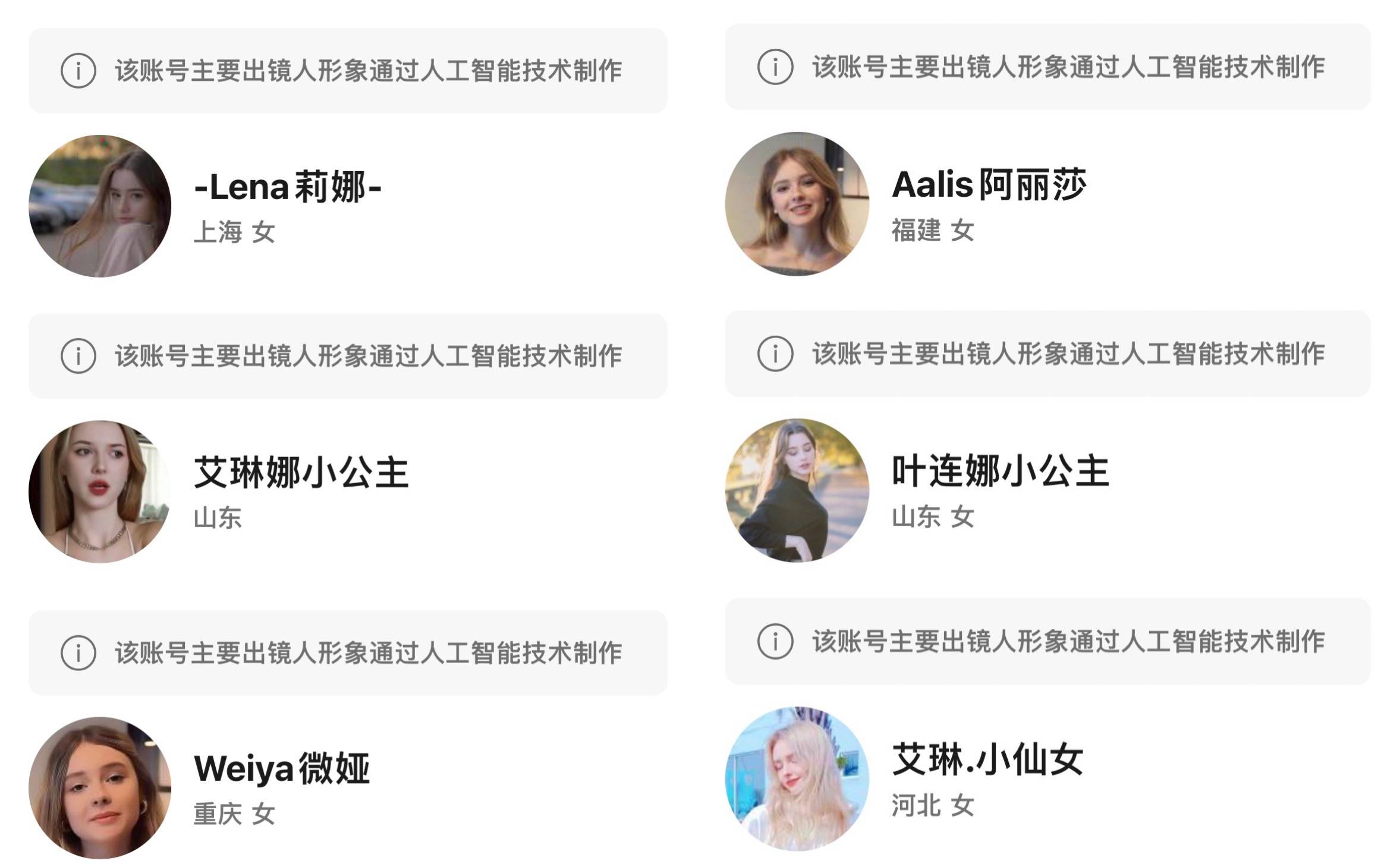

Potrebbero essere sorelle perdute da tempo, Yelena ed Elena sembrano esattamente identiche e i loro IP provengono entrambi dallo Shandong. Sono come una palla di fuoco quando sono raccolti e un cielo pieno di stelle quando sono sparsi. Sono distribuiti in tutto il mondo. Lina è di Shanghai, Nina è dell'Anhui, Irene è dell'Hebei, Katya è di Liaoning e Alyssa è dal Fujian.

Queste bellezze russe sono tutte IA e la piattaforma le ha contrassegnate con attenzione. Possiamo notare la differenza attraverso i loro sfondi esageratamente sfocati, i capelli spettinati, le ripetute serie di espressioni e movimenti e le linee eccessivamente concrete.

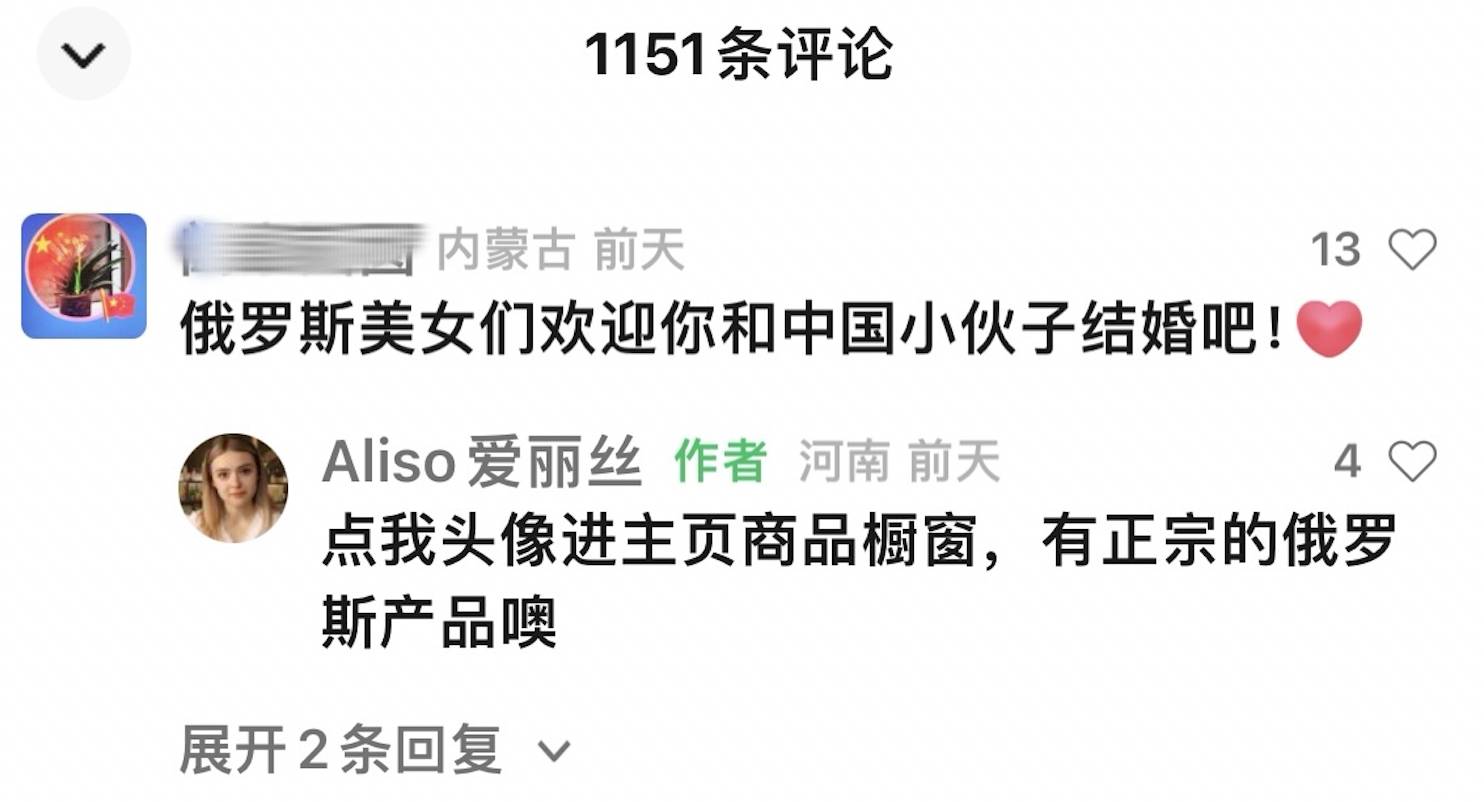

Ma le persone di mezza età e anziane nell'area commenti non potevano vederlo e speravano sinceramente che restassero.Quando hanno risposto, le "bellezze russe" si sono preoccupate solo della loro missione e hanno portato a termine una leggera frode in modo silenzioso.

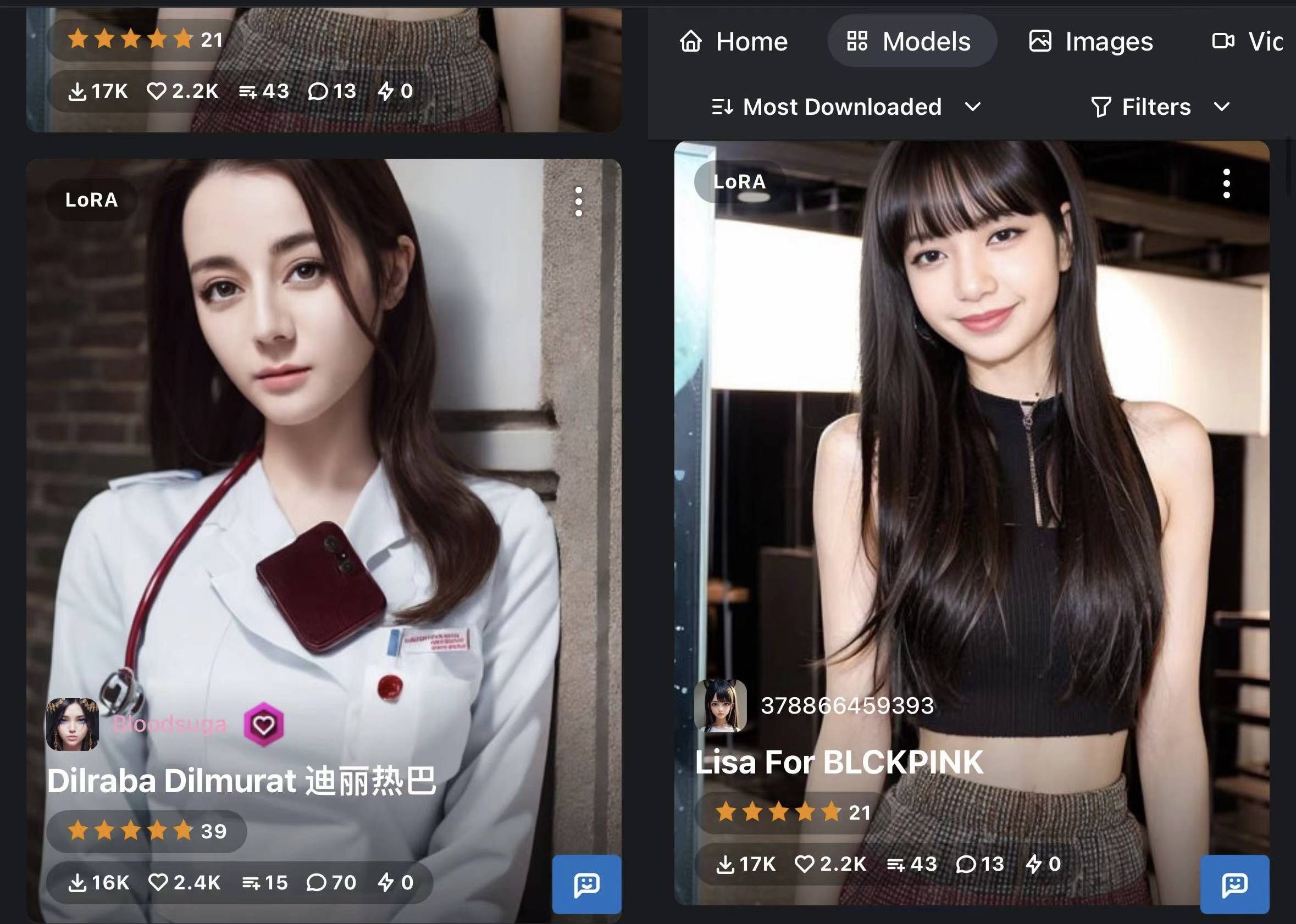

È nella natura umana lasciarsi sedurre dalla bellezza, indipendentemente dall’età. I bellissimi blogger AI di Xiaohongshu usano personaggi alla moda e adatti a Internet per uccidere grandi e piccini. "Uomo d'élite in giacca e cravatta", "studente sportivo in calzini bianchi", "dea del puro desiderio"… A prima vista, ho pensato che fossero persone vere che avevano superato l'immagine P.

Al momento, guardare le mani è ancora l'unico modo per identificare se si tratta di intelligenza artificiale, perché il viso è relativamente piatto e facile da imparare, mentre le mani hanno una struttura tridimensionale, che richiede più lavoro. Inutile dire che il numero delle dita è eccessivo e le nocche sono ruotate così attentamente che è molto sospetto non mostrare le mani se non necessario. Allo stesso modo, anche dettagli come muscoli, arti, vestiti, ecc. possono presentare difetti evidenti.

Il resto dei metodi di identificazione stanno diventando sempre più metafisici e intuitivi: lo stile pittorico è untuoso, il copywriting è torbido, non c'è soffio di vita, gli effetti di luci e ombre sono innaturali, gli occhi sono senza vita, anche il viso è delicato e perfetto, ci sono solo immagini statiche e nessun video, singolo È difficile esserne sicuri guardando solo una foto, ma se guardi qualche altra foto, scoprirai che ogni postura ha la stessa espressione…

Il blogger AI Xiaohongshu @cyberAngel_ è un ingegnere informatico di professione e la pittura con intelligenza artificiale è un hobby che genera elettricità. Non nasconde il fatto di utilizzare l'intelligenza artificiale. Il titolo del suo post recita "Pittura con intelligenza artificiale" e anche il profilo del suo account recita "Sono solo un robot privo di emozioni."

▲ Immagine da: 小红书@cyberAngel_

Allo stesso tempo, @cyberAngel_ ritiene che nei futuri dipinti di intelligenza artificiale diventerà sempre più difficile distinguere tra vero e falso. La generazione e il rilevamento dell'intelligenza artificiale si evolvono insieme. I creatori sono più consapevoli di dove l'intelligenza artificiale non è come le persone reali, quindi lavoreranno è difficile rendere questa parte "come" persone reali. Ad esempio, la bella ragazza prodotta dall'intelligenza artificiale è troppo perfetta, quindi può essere adeguatamente sfocata e aggiungere un "atmosfera cinematografica".

Anche se l'IA beauty blogger non è così reale, è apparsa una trama simile a quella di "Russian Beauty": la piattaforma ha chiaramente suggerito che "si sospetta contenga informazioni sulla creazione dell'intelligenza artificiale". Ci sono ancora persone che lasciano scorregge arcobaleno nel area commenti, e anche chiedendo link ai vestiti: sembra che la questione del vero o del falso lascerà inevitabilmente il posto alla bellezza come giustizia.

Quando il numero di fan aumenta, i blogger di bellezza basati sull'intelligenza artificiale possono monetizzare in molti modi. Alcuni sono autosufficienti e monetizzano il proprio traffico attraverso la pubblicità. Alcuni pagano per la conoscenza, vendono corsi e vendono modelli personalizzati. Secondo @cyberAngel_, "New media There There sono metodi di monetizzazione dei nuovi media e la tecnologia ha metodi di monetizzazione tecnologica”.

▲ Modello di vita reale.

Le "bellezze russe" e i "blogger di bell'aspetto" dell'IA sono in qualche modo simili al "falso Jin Dong" che in precedenza defraudava le donne di mezza età e anziane delle loro emozioni e del loro denaro, ma sono ancora più spaventose e fantasiose.

"Fake Jin Dong" non ha contenuti tecnici. Video e foto relativi alle celebrità vengono scaricati o acquistati in pacchetti. La sua voce affettuosa è forgiata utilizzando un software di cambio vocale. È così ruvida che sembra "falsa a prima vista". L'intelligenza artificiale il livello è più alto e talvolta è reale, non è così facile distinguerlo.

Si può solo dire che quando vediamo bei ragazzi e belle ragazze su Internet, è meglio non dare per scontato che siano persone reali, né essere troppo sinceri. Le società di celebrità di Internet non vogliono spendere soldi per veri KOL, e il pubblico consuma lotti di KOL più rapidamente e le opinioni sulla bellezza e sull'economicità sono così in linea con le leggi sulla comunicazione di Internet.

L'intelligenza artificiale imita il tuo viso e spaventa il tuo cuore

Oltre a gettare un'ampia rete attraverso "blogger di bell'aspetto" e "bellezze russe", l'intelligenza artificiale può anche prendere di mira con precisione.

In altre parole, l’intelligenza artificiale non solo può tessere una dolce campagna, ma anche trasformarsi in un maestro PUA.

Un tipo comune di frode basata sull'intelligenza artificiale è quella in cui il truffatore falsifica l'ID del chiamante e la voce di un conoscente e dice alle persone di mezza età e agli anziani che ricevono la chiamata che i loro nipoti sono nei guai o hanno commesso qualcosa e hanno bisogno di soldi per farlo. risolvono il problema, altrimenti sono in pericolo. Salvati con un riscatto.

All'estero sono state segnalate diverse truffe telefoniche di questo tipo, con trame simili: rapimenti, lesioni, guida in stato di ebbrezza, tamponamenti… Cose simili sono accadute anche in Cina, soprattutto sfruttando la "differenza di tempo e spazio" per inventare il rapimento. di studenti internazionali per frodare i propri genitori.

La routine in sé non è nuova ed è popolare da diversi anni, tuttavia, grazie allo sviluppo tecnologico, i requisiti in termini di potenza di calcolo, campioni e altri aspetti sono stati ridotti, l'effetto è più realistico e la truffa è più facile da implementare.

ElevenLabs, leader nella clonazione vocale tramite intelligenza artificiale, ha bisogno solo di un dollaro e un minuto di audio di alta qualità, consentendoti di padroneggiare istantaneamente 29 lingue e più toni mantenendo il tuo accento, intonazione e ritmo.

Anche se oggi Elevenlabs ha ripetutamente assicurato che solo tu puoi clonare la tua voce, e c'è un processo di verifica per dimostrare che la voce ti appartiene, questa è l'ultima risorsa.Quando Elevenlabs ha lanciato per la prima volta la versione beta nel 2023, le voci clonate delle celebrità come Taylor Swift volavano già ovunque. . Non posso decidere cosa dice l’intelligenza artificiale Taylor Swift.

Tuttavia, sebbene l'interlocutore possa falsificare l'ID del chiamante e la voce, se la persona interessata è lucida, riattacca il telefono, inserisce nuovamente il numero di cellulare e prende l'iniziativa per contattare i parenti, spesso la menzogna sarà autoprodotta. -sconfiggere.

Rispetto alle chiamate vocali, le videochiamate possono rendere le persone di mezza età e anziane che credono che "vedere per credere" più scettiche riguardo alla vita.

L'antica battuta di non sapere chi è un essere umano o un cane dall'altra parte dello schermo non passerà mai di moda e non è difficile da realizzare tecnicamente. Un'operazione più comune è chattare con l'altra parte tramite il software della fotocamera virtuale e la funzione di cambio volto dell'intelligenza artificiale.

Una società tecnologica di Shenzhen intervistata da CCTV che fornisce supporto tecnico all'agenzia di pubblica sicurezza ha affermato che quando si esegue il cambio volto in tempo reale nella chat video, che si tratti di un avatar o di una foto della cerchia di amici, dopo aver caricato l'immagine, è sufficiente il riconoscimento delle caratteristiche circa 30 secondi, quindi l'IA inizia a creare il modello, esegue la conversione in tempo reale al termine della modellazione.

Potresti ancora diffidare dei video uno a uno, ma che dire di un "team di professionisti" uno a molti?

Recentemente, la filiale di Hong Kong di una multinazionale è stata defraudata di 25 milioni di dollari a causa dell’intelligenza artificiale. La vittima era un impiegato finanziario. Ha ricevuto un'e-mail dal "CFO" della sede britannica ed è stato invitato a partecipare ad una videoconferenza sulle "transazioni segrete". All'incontro erano presenti oltre al "CFO" anche diversi “colleghi” familiari”.

I colleghi partecipanti all'incontro non erano realmente presenti: il truffatore ha scaricato il video pubblico, ha falsificato il volto e la voce della persona reale tramite Deepfake, per poi applicarli alla videoconferenza. Per evitare di svelare il segreto, il "CFO" ha dato l'ordine unilateralmente. I "colleghi" non hanno comunicato con la vittima e il video è stato subito riattaccato. Il truffatore ha continuato a contattare la vittima tramite e-mail e altri metodi.

▲ La polizia ha dimostrato come utilizzare Deepfake per simulare una videoconferenza tra più persone.

Sebbene ci siano risultati di indagini su questo argomento, alcuni netizen sospettano che si tratti solo di un insider. Le misure di gestione del rischio e di controllo delle multinazionali sono sconosciute, ma quello che è certo è che il cambio di volto tramite intelligenza artificiale può essere esteso anche a molti luoghi, dai primi cambi di testa nei film pornografici alle celebrità false che portano merci nelle sale di trasmissione dal vivo.

Fortunatamente, l’intelligenza artificiale non è ancora perfetta e il metodo di identificazione è ancora semplice e fattibile.

Se si tratta di un video che cambia volto tramite l'intelligenza artificiale, l'immagine originale della fotocamera consuma molta potenza di calcolo durante la conversione di più livelli e il suono e l'immagine vengono spesso ritardati. Inoltre, puoi guidare l'altra persona a compiere alcune azioni, come aprire la bocca, scuotere la testa in modo significativo, muovere le dita avanti e indietro davanti al viso, ecc. Se l'IA cambia volto, la "faccia" potrebbe essere deformato e imperfetto.

Oltre a superare i bug tecnici, c'è un altro trucco che è stato provato e testato ogni volta, ovvero porre alcune domande sulla privacy che tu sai, io so e lui non lo sa, oppure puoi inventare bugie e deliberatamente usa i trucchi per vedere come risponde l'altra parte.

Naturalmente, la mancanza di tecnologia può risolvere solo difficoltà temporanee. Tanto vale disprezzarla strategicamente e prestarle attenzione tatticamente. Non possiamo pensare di non lasciarci ingannare. Può darsi che il gioco di fascia alta non sia ancora apparso .

Le truffe legate all’intelligenza artificiale non sono una novità, ma è emerso un nuovo divario digitale

Il 2023 è noto come il primo anno dell’intelligenza artificiale generativa. Tuttavia, la promozione della tecnologia è in ritardo. Forse ciò che la maggior parte delle persone comuni può percepire meglio è come la tecnologia, che non sembra nuova ma è diventata più popolare negli ultimi anni, abbia influenzato la vita quotidiana.

Tutti capiscono che la tecnologia è un’arma a doppio taglio: Elevenlabs consente alle persone con barriere linguistiche di parlare, HeyGen consente a Swift di sincronizzare le labbra in cinese senza traduzione e Miaoya Camera consente alle persone di ottenere certificati raffinati senza uscire di casa. non c'è giusto o sbagliato tra il lato positivo e il lato oscuro della tecnologia, esistono semplicemente oggettivamente.

Tuttavia, per molte persone di mezza età e anziane gli smartphone e Internet risultano incomprensibili e ora l’intelligenza artificiale è di nuovo causa di problemi.

Nell'era dell'intelligenza artificiale, testi, suoni, immagini e video possono essere falsi o addirittura apparire in combinazione. Le identità contraffatte dei truffatori sono più specifiche e la frode è più mirata e genuina, rendendo le persone di mezza età e anziane più probabile che venga ingannato.

Usare la magia per combattere la magia e usare la tecnologia per attaccare e difendere la tecnologia è un gioco del gatto e del topo che le persone di mezza età e gli anziani potrebbero non essere in grado di digerire rapidamente. Potremmo iniziare dalla natura della frode per ridurre la possibilità di mediazione. -anziani e persone anziane che vengono ingannate.

Non importa come si sviluppa la tecnologia, molti schemi di frode rimangono gli stessi: rubare la privacy, usare la paura, l’avidità e il valore emotivo per inventare storie, fingere di essere conoscenti o confezionarsi per guadagnare fiducia, con il denaro come obiettivo finale.

Dopo che l'AI Fashion Pope è uscito dal settore, un X (ex Twitter) V con quasi 13 milioni di fan si è lamentato: "Pensavo che il piumino del Papa fosse reale e non ci ho pensato molto. Non posso sopravvivere il futuro della tecnologia."

Per le persone di mezza età e anziane è più difficile adattarsi alle regole secondo cui vedere non è necessariamente vero e le immagini non sono necessariamente vere. Possiamo mostrare loro alcuni metodi semplici, tradizionali ma comunque efficaci.

Un tipo è quello di fare attenzione e non fidarsi facilmente del contenuto di Internet, non rispondere a chiamate moleste, non fare clic su collegamenti non familiari e cercare di non sovraesporre informazioni biometriche personali come volti, voci, impronte digitali, ecc. Internet.

Soprattutto quando ricevi telefonate o messaggi di testo sospetti, non credere ciecamente alle "parole unilaterali". Non importa chi sia l'altra parte, hanno molteplici prospettive quando si tratta di denaro. Utilizza più metodi per verificare le opinioni dell'altra parte. Se l'altra persona dice che è successo qualcosa alla tua famiglia, richiamala di nuovo e chiama per confermare se è vero.

L’altro tipo è proattivo e preparato: le persone di mezza età e gli anziani hanno i propri media preferiti e i loro familiari possono inoltrare loro contenuti antifrode dagli account ufficiali WeChat dei dipartimenti governativi e da altre fonti. Se le condizioni lo consentono, puoi anche mostrare alle persone di mezza età e agli anziani come utilizzare strumenti di intelligenza artificiale come ChatGPT.

Naturalmente per gli anziani che non capiscono gli smartphone si cerca di risolvere il problema alla fonte: è meglio non vincolare le carte bancarie a WeChat o Alipay e risparmiare solo una piccola somma di resto.

Il successo delle frodi legate all’IA è solo il risultato finale, ma la prevenzione delle frodi legate all’IA può iniziare in qualsiasi momento.

La tecnologia dovrebbe essere al servizio di tutti, aprire la strada, illuminare il faro del mondo digitale per coloro che verranno dopo di noi ed esplorare le barriere coralline sottomarine sconosciute. Solo allora potremo muoverci insieme verso un futuro in cui la tecnologia non sarà temuta ma utilizzata razionalmente.

# Benvenuti a seguire l'account pubblico WeChat ufficiale di aifaner: aifaner (ID WeChat: ifanr). Contenuti più interessanti ti verranno forniti il prima possibile.

Ai Faner | Link originale · Visualizza commenti · Sina Weibo