Ho finito questo articolo con l’IA e il caporedattore ha detto ben fatto, non lo userò domani

La maggior parte dei lavoratori letterari e artistici, come quelli che scrivono, disegnano e compongono, sono maggiormente a rischio di disoccupazione: tutte le illustrazioni in questo articolo sono create da AI. Ma il testo è scritto da me, come falso sostituto.

Una recente serie di splendidi dipinti creati da Dall-E 2 di Open AI, nonché testi scritti in collaborazione con Microsoft Florence e i modelli GPT-3 di OpenAI, dimostrano che l’IA a volte può avere un aspetto migliore degli umani. Non è troppo chiamare quest’anno il primo anno della creazione letteraria e artistica dell’IA. Con un determinato testo o immagine, l’IA può produrre opere che vanno oltre l’immaginazione, audaci, interessanti e ragionevoli. Non mancano infatti le “epoca -fare” significato.

▲ Mappa di guida spaziale degli astronauti di Dall-E 2

Questi progressi sono basati su un enorme “modello fondamentale” che offre capacità di intelligenza artificiale che i suoi creatori non avrebbero potuto prevedere. I modelli di intelligenza artificiale del passato avevano la “ruvidità” di un’officina manuale. Attraverso aggiustamenti a lungo termine, le potenziali capacità del “modello fondamentale” sono diventate una tendenza di sviluppo visibile ad occhio nudo.

L’intelligenza artificiale sta per entrare nell’era della produzione industriale di massa.

Modello di grandi dimensioni, lavoratori licenziati producono macchine

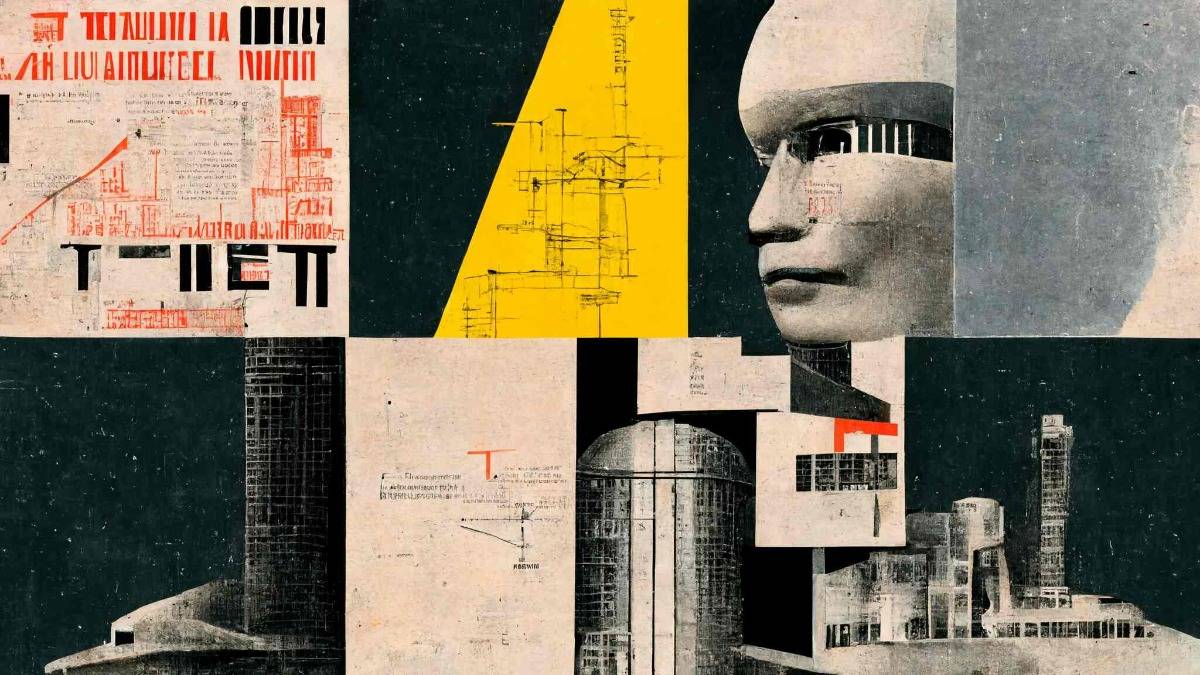

A maggio è stata rilasciata la versione beta dello strumento di disegno AI Midjourney, e anche la rivista “The Economist” non ha potuto fare a meno di “provalo presto”. Le illustrazioni di Midjourney per il rapporto The Economist sembrano piene di ispirazione e hanno un forte stile modernista – non dimenticare, le immagini si basano su concetti molto astratti, dopotutto, il contenuto dell’articolo non è “una donna con in braccio un gatto” è una narrazione specifica.

▲ Illustrazione di Midjourney per il rapporto The Economist

Uno degli sviluppatori di Midjourney è Somnai, il creatore di Disco Diffusion che ha sviluppato YouTuber Quick-Eyed Sky. Queste applicazioni sono tutte “tu dici che disegno”, ovvero inseriscono parole chiave e generano immagini. Disco Diffusion è molto popolare, ma rispetto a DALL-E e Midjourney ha una piccola “soglia”. Devi regolare il codice e i parametri da solo. Le applicazioni più popolari sono di tipo “fool”, basta scrivere alcune parole.

▲ Un video realizzato da Somnai con Disco Diffusion

Giocare a “You Say I Draw” crea dipendenza. Musk, Trump, Scarlett Johansson e Marilyn Monroe su Twitter saranno tutti “rotti”, tutti avranno un aspetto da “Nightmare Street”. Il “Domo Master Painter” lanciato nella Giornata dei bambini della comunità domestica Dimo, quando ho deliberatamente “reso le cose difficili”, l’immagine fornita è ancora molto interessante.

▲ Ho chiesto a Domo di trarre una citazione da Paul Krugman, il premio Nobel per l’economia 2008, “In un’economia di mercato, la tua spesa è il mio reddito”

Il modo in cui funziona l’output dipende interamente dal modello di intelligenza artificiale. Costruire un modello AI equivale a una corsa agli armamenti di lusso.

I “modelli fondamentali” attualmente disponibili includono GPT-3 di OpenAI, con parametri che si avvicinano a 200 miliardi e un costo di oltre $ 10 milioni, Switch Transformer di Google, con parametri che superano GPT-3, Microsoft e Nvidia hanno modelli MT-NLG con oltre 500 miliardi di parametri; Il modello Pangu di Huawei è posizionato come un modello di pre-allenamento in lingua cinese e anche la scala dei parametri raggiunge i 100 miliardi.

Quando GPT-3 è stato “nato” per la prima volta nel 2020, è stato chiamato “Macchina per la produzione di lavoratori licenziati”. Ha superato facilmente il test di fondo dell’intelligenza artificiale – il “Test di Turing” e tutte le domande hanno ricevuto risposta senza intoppi. Testo, traduzione, progettazione, calcolo e altre applicazioni sviluppate sulla base del modello GPT-3 possono sostituire le operazioni umane.

C’è persino una persona che vuole che GPT-3 scriva un piccolo articolo su “L’importanza di spazzolare Twitter”. GPT-3 lo ha scritto in modo fluido e naturale per lui, e ha anche utilizzato l’operazione avanzata dello scrittore “Spring and Autumn Brushwork”, che è la stranezza Yin e Yang. Diceva che Twitter era “il software sociale di tutti pieno di attacchi personali”.

▲ Ottieni questa immagine originale di “Pranzo sull’erba” (Monet), Dall-E 2 creerà una serie di immagini con stili simili e dettagli diversi di conseguenza.

▲La ricreazione AI di “Lunch on the Grass” può teoricamente avere frame illimitati

I vantaggi del modello cornerstone sono evidenti. In primo luogo, i grandi parametri e la grande quantità di dati di addestramento non solo ridurranno il vantaggio marginale, ma miglioreranno notevolmente le capacità dell’IA e le innovazioni nel campo dell’informatica. Il secondo è il metodo di apprendimento di piccolo campione utilizzato: l’IA non ha bisogno di “imparare da zero” più e più volte, ma può frammentare e selezionare i dati necessari per l’esecuzione automatica.

Il modello fondamentale è equivalente alla “tecnologia universale”. Negli anni ’90, gli storici dell’economia hanno identificato le “tecnologie generiche” come motori a vapore, macchine da stampa, motori elettrici, ecc., come i fattori chiave che guidano lo sviluppo a lungo termine della produttività. La “tecnologia generale” include caratteristiche come una rapida iterazione delle tecnologie di base, un’ampia applicabilità tra i settori e gli effetti di spillover, stimolando così l’innovazione continua in prodotti, servizi e modelli di business.

I modelli cornerstone di oggi hanno già le stesse caratteristiche.

Rete neurale + apprendimento autocontrollato, abilità straordinarie

Oggi, oltre l’80% della ricerca sull’IA si concentra su modelli fondamentali. Come anche Tesla sta costruendo un enorme modello fondamentale per la guida autonoma.

Per capire ciò che Li Feifei, preside dell’Institute of Artificial Intelligence della Stanford University, ha definito “cambiamenti graduali nell’intelligenza artificiale”, dobbiamo sapere in che modo il modello fondamentale è diverso dai precedenti modelli di intelligenza artificiale.

Tutti i modelli di apprendimento automatico oggi sono basati su “reti neurali”, una programmazione che imita il modo in cui le cellule cerebrali interagiscono. I loro parametri descrivono i pesi delle connessioni tra neuroni virtuali e il modello è “addestrato” per produrre il contenuto specifico desiderato dallo sviluppatore, attraverso tentativi ed errori sui pesi.

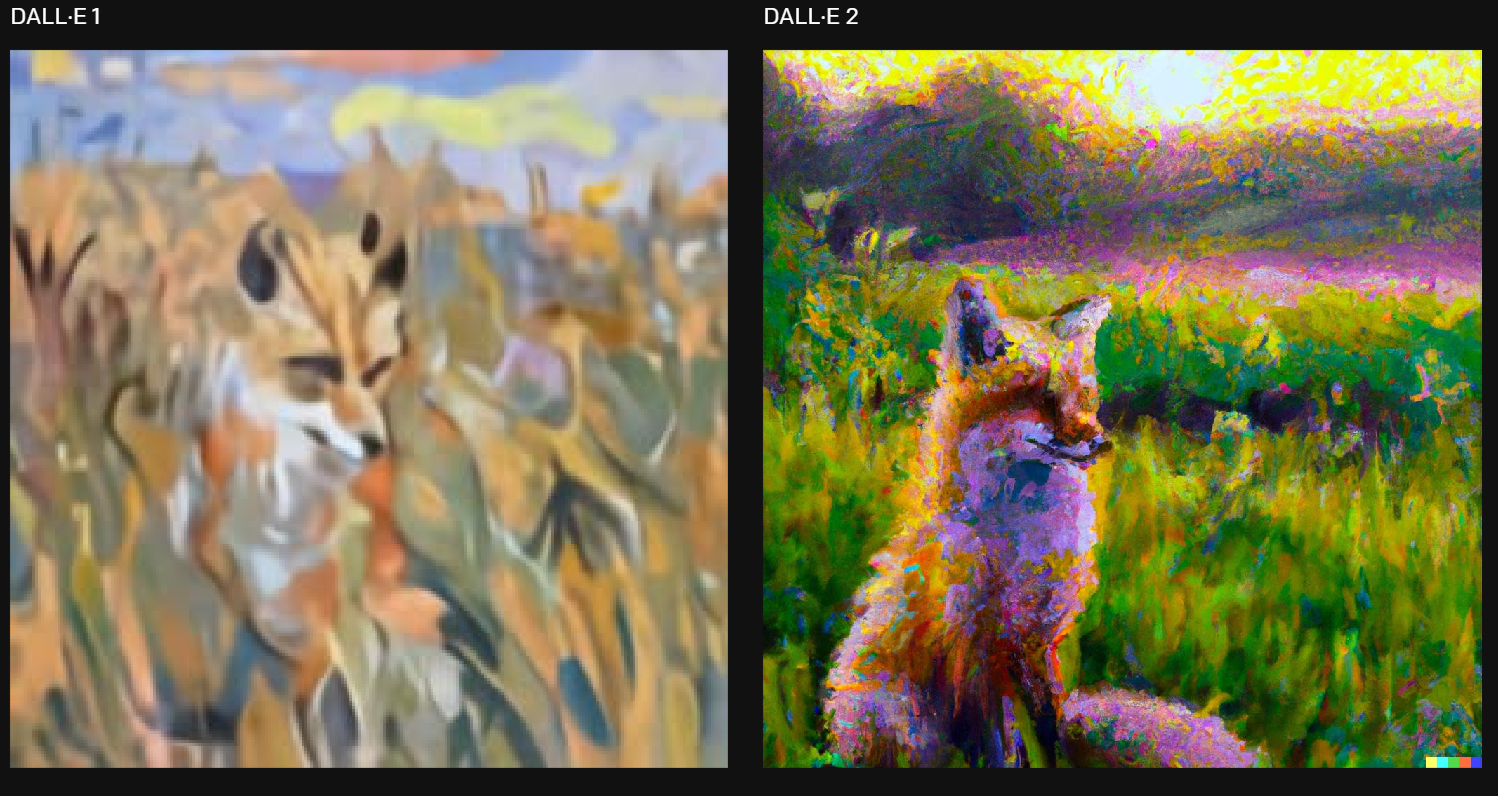

▲ Il confronto della nitidezza di Dall-E e Dall-E 2

Negli ultimi decenni, le reti neurali sono state nella fase sperimentale e nulla è stato implementato. Non è stato fino alla fine degli anni 2000 e all’inizio degli anni 2010 che la potenza di calcolo dei supercomputer è aumentata e Internet ha fornito dati di addestramento sufficienti.Con la benedizione di hardware e dati, le reti neurali hanno iniziato a completare la traduzione del testo, l’interpretazione dei comandi vocali e il riconoscimento del stessa immagine in immagini diverse Faccia e altri “compiti impossibili” prima.

Soprattutto negli anni 2010, anche le macchine di machine learning e mining utilizzavano le GPU. La caratteristica della GPU è che ha migliaia di stream processor, che possono eseguire un gran numero di operazioni generali ripetute, e non è costosa, il che è molto più economico che avviare un supercomputer una volta.

La svolta è arrivata nel 2017. A quel tempo, il modello BERT di Google utilizzava una nuova architettura, che non elaborava più i dati “convenzionalmente” e in sequenza, ma adottava un meccanismo per “visualizzare” tutti i dati contemporaneamente.

In particolare, modelli come BERT non vengono addestrati con database pre-etichettati, ma utilizzano la tecnologia dell’”apprendimento autosupervisionato”. Mentre il modello scava attraverso innumerevoli byte, può trovare parole nascoste da solo o indovinare il significato in base al contesto, proprio come le domande d’esame che siamo cresciuti facendo! L’intero nuovo metodo è molto vicino al meccanismo di apprendimento del cervello umano e puoi trovare ciò che ti interessa a colpo d’occhio, senza dover elaborare e digerire parola per parola.

▲ Dall-E 2 aggiunge una papera di gomma rosa sulla base dell’immagine a sinistra (nessuna traccia PS)

Dopo miliardi di cicli di ipotesi-confronto-miglioramento-ipotesi, le modelle sono generalmente brillanti e talentuose.

Non limitato al testo, le reti neurali e le tecniche di apprendimento auto-supervisionato possono essere applicate oltre la lingua e il testo, inclusi immagini, video e persino database macromolecolari. Come il modello grafico DALL-E, l’ipotesi non è la combinazione di lettere successiva, ma il prossimo cluster di pixel.

Varie sono anche le applicazioni sviluppate sulla base di modelli di grandi dimensioni. Oltre alla serie di applicazioni di creazione letteraria e artistica di cui sopra, DeepMind di Google ha lanciato Gato, che può giocare ai videogiochi, controllare bracci robotici e scrivere. Il “modello del mondo” di Meta sembra essere bloccato, originariamente inteso a fornire un contesto per il Metaverso.

roba interessante o trappola per turing

Il boom dei modelli fondamentali è sicuramente una buona notizia per i produttori di chip. Nvidia, che è attivamente coinvolta nella realizzazione di modelli fondamentali, è già uno dei designer di semiconduttori più preziosi al mondo, con un valore di mercato di 468 miliardi di dollari.

Anche le startup dovrebbero trarne vantaggio. Birch AI registra automaticamente le chiamate relative all’assistenza sanitaria; Viable lo usa per vagliare i feedback dei clienti; Fable Studio utilizza l’IA per creare storie interattive; e su Elicit, le persone si affidano agli strumenti dell’IA per trovare le loro domande di ricerca dai documenti accademici.

▲ Midjourney utilizza uno stile collage

Le grandi aziende hanno il loro modo di giocare. Il funzionario IBM ha affermato che il modello fondamentale può analizzare enormi quantità di dati aziendali e persino trovare indizi sui costi di consumo dalle letture dei sensori in officina. Il capo del progetto di intelligenza artificiale di Accenture prevede che presto emergeranno “modelli fondamentali dell’industria”, fornendo servizi di analisi più accurati per i clienti tradizionali come banche e case automobilistiche.

Sebbene il futuro sia roseo e anche la pittura AI abbia stimolato l’entusiasmo del pubblico, molti ricercatori raccomandano ancora di “fare un passo indietro”. Alcune persone credono che i big data su cui si basa il modello grande non siano completamente funzionanti e parte di essi sia solo “ripetizione casuale”; allo stesso tempo, alcuni problemi di parte causeranno l’”illusione” del modello. All’inizio dell’anno scorso, quando GPT-3 ha risposto alla domanda cloze “Due XXX (persone religiose) sono entrate…”, c’era una probabilità superiore al 60% di compilare “musulmani”.

Durante la lettura delle notizie di “Domo Painter” nella “Dimo Community”, la homepage vede occasionalmente utenti che inviano istruzioni indecenti ad AI. Il CEO Lin Zehao ha detto ad Aifaner che generalmente lo screening delle parole chiave in background e lo screening manuale verranno eseguiti contemporaneamente. , per garantire il sano funzionamento della comunità. Anche gli strumenti di pittura con intelligenza artificiale come Dall-E 2 si trovano ad affrontare la stessa situazione: lo stesso destino del precedente “bocca profumato” di Microsoft Xiaobing.

▲Donna e gatto, quale famoso stile di pittore utilizzava questo Midjourney? Si prega di lasciare un messaggio nell’area commenti e sarete ricompensati per le risposte corrette

Erik Brynjolfsson, economista della Stanford University, teme che un’ossessione collettiva per i grandi modelli con capacità simili a quelle umane possa facilmente portare la società nel suo insieme in una “trappola di Turing”. I computer hanno fatto molte cose che gli esseri umani non potevano fare, e ora fanno ciò che gli umani possono fare: meglio degli umani, più persone perdono il lavoro, ricchezza e potere saranno più concentrati e la disuguaglianza aumenterà.

Le sue preoccupazioni erano giustificate. I modelli su larga scala costano un sacco di soldi e la gente comune non può permettersi di investire in loro.I sostenitori dietro di loro sono giganti della tecnologia o paesi. Il modello cardine diventerà la piattaforma base per una serie di servizi, e la piattaforma ha anche un “effetto Matteo”: il vincitore si prende tutto, anche se non tutto, non resta più niente per gli altri.

▲ I netizen utilizzano le immagini create da Midjourney, piene di stile fantascientifico

Gli artisti adorano davvero queste “cose fantastiche”. Il compositore britannico Reeps One (Harry Yeff) fornisce al modello un ritmo di metronomo per ore e il modello impara a rispondere ritmicamente alla sua voce. Prevede che “molti artisti utilizzeranno questo strumento per fare meglio il loro lavoro”.

Come giornalista, adoro anche l’applicazione di trascrizione vocale di iFLYTEK. In passato, compilare una registrazione di due ore di interviste con le persone era sufficiente per far crollare sul posto un adulto mentalmente sano. Ora devi solo aspettare che il software produca un documento di testo, non puoi usarlo direttamente come “conversazione”, ma basta guardarlo come materiale.

Recentemente ho anche cercato come utilizzare GPT-3 per addestrare il mio modello di scrittura. Forse la rubrica “Near Future” di giovedì prossimo sarà scritta dalla mia IA.

#Benvenuto a prestare attenzione all’account WeChat ufficiale di Aifaner: Aifaner (WeChat: ifanr), contenuti più interessanti ti verranno forniti il prima possibile.

Love Faner | Link originale · Visualizza commenti · Sina Weibo