Quando premi l’otturatore per scattare una foto, il telefono ha problemi di matematica

Se sei povero, la meccanica dei fluidi sarà migliore, e se hai il coraggio, volerai con grande forza. Questa è una barzelletta che circola negli ambienti dell’aviazione.

▲ MiG 25: un viaggio in paradiso su un pezzo di acciaio inossidabile.

Si riferisce alla storia dell’Unione Sovietica che ha fatto volare 32 tonnellate di acciaio inossidabile a 3,2 Mach, cosa che ha scioccato gli Stati Uniti in quel momento. Rispetto al velivolo da ricognizione SR-71 Blackbird che è pieno di tecnologia nera, l’approccio del MiG-25 è diretto ed efficace, utilizzando direttamente due motori a razzo per risolvere il problema.

Secondo il pensiero non convenzionale degli ingegneri sovietici, l’aereo a forma di “mattone” può facilmente volare a velocità supersoniche.

L’astronave di Musk SN6 Immagine tratta da: cnet

Finora, l’esempio del “grande mattone volante” dovrebbe essere il prototipo dell’astronave di Musk, che ha lo stesso effetto del MiG 25 e fa miracoli con vigore.

Se l’interessante discorso del circolo dell’aviazione viene trasferito nel campo dell’imaging, può anche essere abbinato.

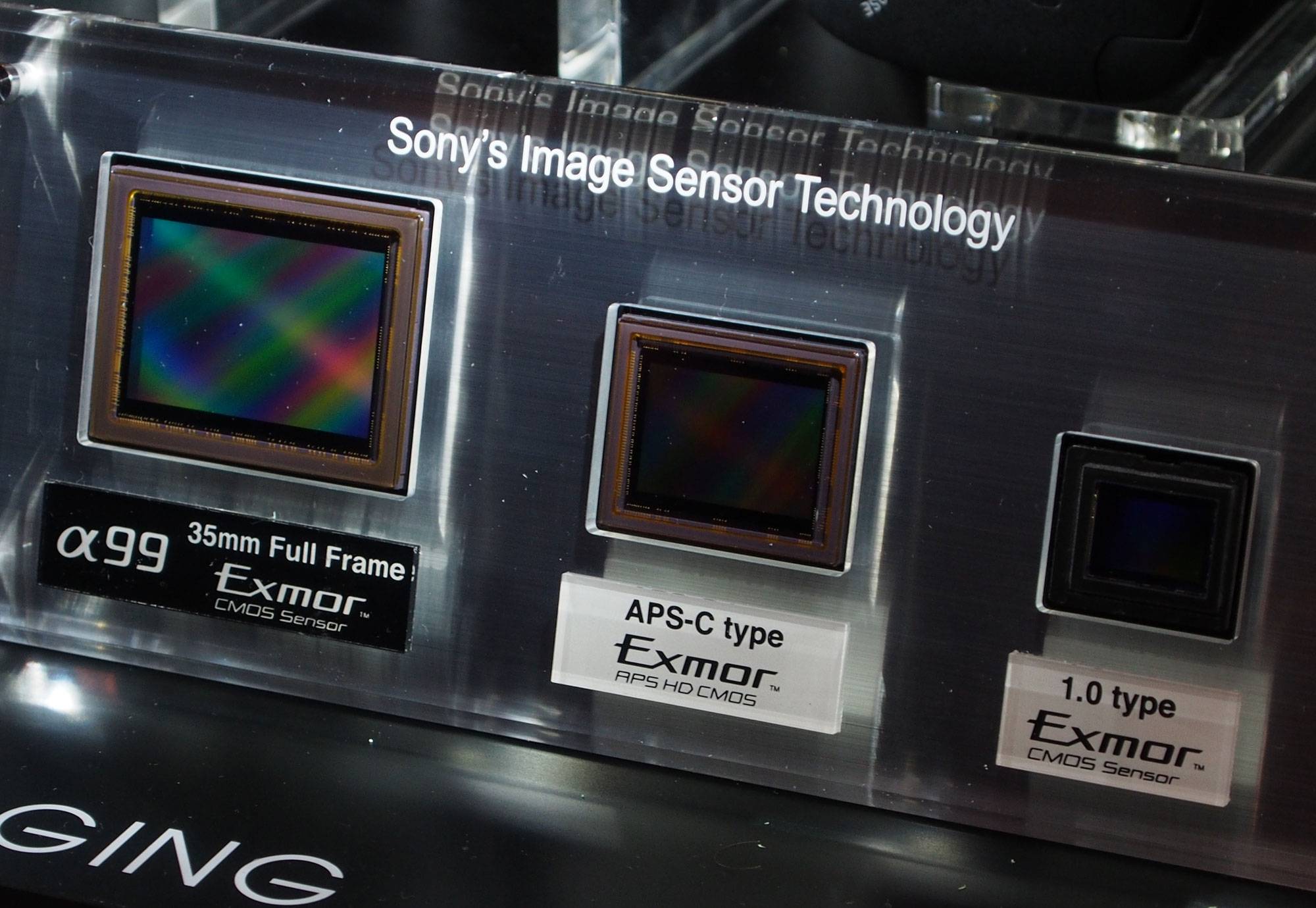

Nell’era digitale, la qualità dell’output dell’immagine può essere quasi proporzionale alla dimensione del sensore. Maggiore è la dimensione, maggiore è il vantaggio naturale. Con le catene dell’ottica fisica tradizionale, è difficile “contrattaccare”.

Il sensore dello smartphone ha solo le dimensioni di un “tappo per unghie” ed è limitato dalle sue dimensioni, il design dell’obiettivo è in un dilemma. Con il tradizionale pensiero per immagini, c’è la sensazione di essere attaccati dal nemico, ed è difficile sfondare il limite superiore della fisica, per non parlare di alcune innovazioni che sono benvenute.

▲ Marc Levoy, considerato il padre della “fotografia computazionale”

Fino al rilascio della prima generazione di Google Pixel, che ha vinto la corona di DxOMark in un colpo solo. A quel tempo, le persone hanno gradualmente realizzato il fascino della “fotografia computazionale”.

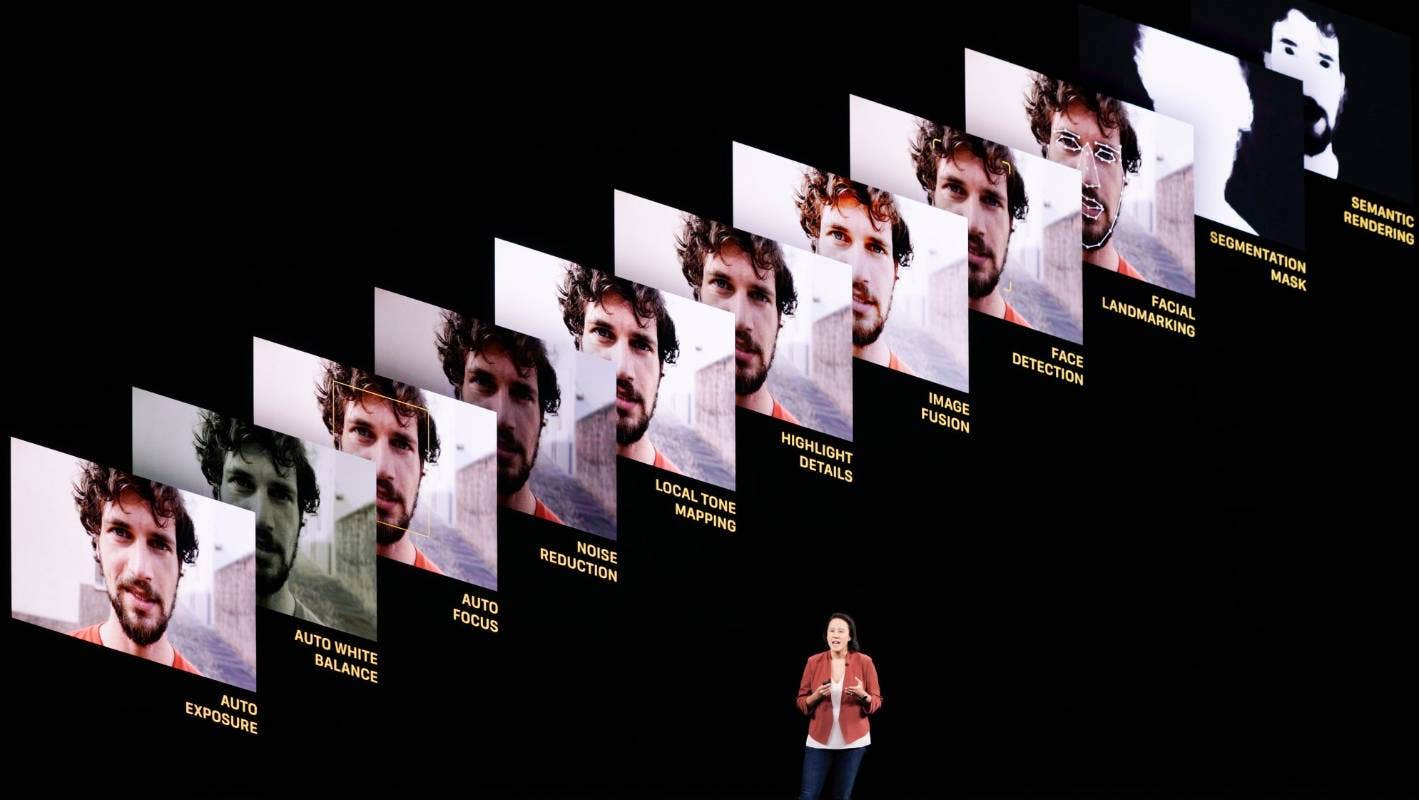

Al lancio della serie iPhone 12, Apple ha dedicato molto tempo all’introduzione dei progressi e dei miglioramenti funzionali apportati dalla “fotografia computazionale” su iPhone.

Si può dire che la fotografia computazionale è diventata una tendenza in questo momento, e rispetto alla stagnazione dell’ottica fisica tradizionale, sembra avere un potenziale maggiore, e anche il regno dei “grandi mattoni volanti” può essere raggiunto dai soli algoritmi.

In passato, l’algoritmo poteva essere solo la ciliegina sulla torta, migliorando il colore dell’immagine, la scena notturna più pulita e la retroilluminazione più chiara, ma di recente l’elaborazione delle “immagini” in MIX 4 e iOS 15 non solo è rimasto al livello del “bello”.

Xiaomi MIX4.

Si può dire che il più grande punto forte di Mi MIX 4 sia lo schermo intero realizzato dalla tecnologia della fotocamera sotto lo schermo. Il concetto di schermo intero viene gradualmente implementato e, oltre alle scoperte nella tecnologia dello schermo, anche la fotografia computazionale ha svolto un ruolo importante in esso.

Al momento, lo schermo dell’area CUP utilizza tecnologie come “piccoli pixel” e “fili trasparenti” per evitare effetti di diffrazione e migliorare la trasmissione della luce, ma rispetto ai normali schermi OLED, la sua trasmissione della luce è ancora inferiore al 20%.

▲ Prototipo di fotocamera sottoschermo OPPO.

Prima di Xiaomi MIX 4, OPPO ha anche annunciato il proprio prototipo di fotocamera sotto lo schermo e ha affermato che il prossimo obiettivo è aumentare la trasmissione della luce al 40%, ma c’è ancora molto spazio per il tradizionale 90%.

E questa lacuna è stata trasferita alla “fotografia computazionale”, che ha trasformato l’ottica fisica in una serie di problemi matematici.

Secondo la condivisione di Xiaomi, le fotocamere MIX4 verranno calibrate una per una in base allo schermo sulla linea di produzione, quindi verrà utilizzato il “modello di diffrazione” per ridurre l’effetto di diffrazione, ed eseguire operazioni come HDR multi-frame, rumore riduzione e disappannamento Eseguire una serie di dettagli, ottimizzazione del colore e così via.

▲ Mi MIX 4 chiama selfie in QQ.

Tale operazione, attraverso la nostra precedente misurazione effettiva, può sostanzialmente ottenere un effetto selfie vicino all’80%. Tuttavia, le chiamate di questi algoritmi sono limitate alle proprie app della fotocamera. Non sono ancora aperte a terze parti o ottimizzazioni mirate di terze parti. È facile “esporre” la chiamata front-end dell’app di terze parti.

In iOS 15, Apple ha anche utilizzato “algoritmi” per eliminare un difetto ottico nella fotocamera dell’iPhone.

▲ Girato su iPhone. Immagine da: Reddit

A partire dalla serie iPhone 11, a causa del design del gruppo di lenti, le “immagini fantasma” appariranno quando si scatta con una fonte di luce puntiforme, soprattutto di notte, come se ci fosse uno specchio trasparente nel mondo reale.

Che fosse su Weibo o Reddit, si è discusso molto: fino al rilascio della serie iPhone 12, Apple non ha ancora apportato modifiche e l’immagine del fantasma è rimasta la stessa.

▲ L’immagine a destra mostra iOS 15 Beta 4. Immagine da: Reddit

Nell’aggiornamento iOS 15 Beta 4, Apple ha utilizzato algoritmi per gestire le immagini fantasma in alcune foto. Oltre alla cancellazione, questa funzione di iOS 15 Beta 4 riconoscerà automaticamente anche le immagini fantasma in base al contenuto dell’immagine.

In questo modo, le foto di paesaggi sono più facili da giudicare, mentre all’interno potrebbero non essere così efficaci e le immagini fantasma esistono ancora.

▲ L’immagine a destra mostra iOS 15 Beta 4. Immagine da: Reddit

E, sotto i post relativi a Reddit, i fantasmi possono essere ottimizzati da iPhone XS a iPhone 12 Pro Max, non limitato agli ultimi modelli. Con l’arrivo della versione ufficiale di iOS 15 a settembre, credo che il problema del “ghosting” verrà eliminato ancora meglio.

Nel campo dell’imaging tradizionale, le “immagini fantasma” possono essere solo evitate ed è difficile eliminarle completamente attraverso la progettazione ottica. L’obiettivo ultra grandangolare utilizza obiettivi grandi esagerati e obiettivi speciali come vari obiettivi asferici all’interno per evitare “difetti”.

L’uso di algoritmi da parte di Apple per risolvere i difetti ottici può essere descritto come un nuovo modo, che salta fuori dal pensiero inerziale dei tradizionali produttori di immagini di impilare i materiali sulle lenti per risolvere i difetti.

Jon McCormack.

Ricordo che in un’intervista dopo la conferenza della serie iPhone 12, Jon McCormack, vicepresidente del software di Apple e responsabile del sistema di imaging dell’iPhone, ha affermato che “il modo di pensare di Apple non è lo stesso di quello dei produttori di immagini professionali tradizionali”. “Il nostro obiettivo è far raccontare a tutti le proprie storie.”

Vale a dire, rispetto ai prodotti con attributi dello strumento come micro-single e SLR, le immagini degli smartphone sono più dal punto di vista dell’utente, come l’ottimizzazione dei colori tramite algoritmi, la sintesi multi-frame di “scene notturne”, HDR e così via .

Allo stesso tempo, gli smartphone sono attualmente l’unico dispositivo in grado di combinare raccolta, modifica, elaborazione e condivisione in uno, con uno stato speciale. Questo è anche il caso che ha dato vita alla “fotografia computazionale”, considerata come un percorso di “spada protesa in avanti” nel campo della fotografia tradizionale.

Diversamente dagli attuali produttori di immagini professionali, compresi i produttori di telefoni cellulari, hanno esplorato l’innovazione rivoluzionaria di Camera 3.0. (La fotocamera 1.0 è l’era del cinema e la 2.0 è l’era digitale, passando dal campo della chimica al campo della fisica.)

▲ Luce L16. Immagine da: theVerge

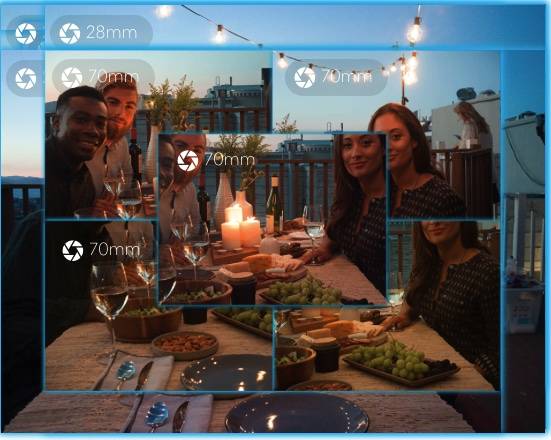

La fotocamera multiobiettivo Light L16 è stata chiamata il “Future of Cameras” dal Wall Street Journal e National Geographic l’ha persino definita una fotocamera rivoluzionaria.

Il suo principio di acquisizione è ora simile a quello del sistema multi-camera di uno smartphone: 16 obiettivi (grandangolo, teleobiettivo, teleobiettivo medio, ecc.) partecipano all’acquisizione delle immagini insieme e alla fine producono una foto “perfetta”.

▲ Diversi obiettivi utilizzati nell’imaging finale del Light L16.

Non appena è uscito il concetto di Light L16, è diventato il beniamino dei media allo stesso tempo, ha anche ricevuto 30 milioni di dollari di investimenti da Google Ventures, ma il prodotto è stato costantemente rimbalzato e rimandato.

La fotocamera Light L16 che finalmente è andata sul mercato non ha completato la visione originale, tranne che per il disordine di hardware e software. Dopo aver testato l’editor della fotocamera Ki_min di Mobile01 nella provincia di Taiwan, ha scoperto che il cosiddetto algoritmo di sintesi multi-obiettivo è in realtà un semplice ritaglio digitale e molte funzioni non sono state implementate.

La cosa più importante è che Light L16 non ha alcuna potenza di calcolo per risolvere l’elaborazione “one-stop” nella macchina e ha ancora bisogno dell’assistenza di una piattaforma di elaborazione a livello di PC per completare l’output finale.

Guardando indietro ora, Light L16 dovrebbe essere considerato solo un prodotto semilavorato, e meno lo è in realtà la piattaforma di calcolo e l’algoritmo. Il successo di attirare molta attenzione dei media e diventare il beniamino dei media si basa in realtà sul concetto di imaging, cioè l’algoritmo, e ora è “fotografia computazionale”.

L’apparizione iniziale della “fotografia computazionale” era in realtà quella di sopperire alle carenze dei piccoli componenti sensibili alla luce dei telefoni cellulari. Con l’aumento della potenza di calcolo dei chip, l’imaging degli smartphone è diventato gradualmente una lunga pista competitiva, rendendo “computazionale fotografia” un miglioramento completo.

Ora, con l’ottimizzazione dell’algoritmo, lo schermo intero CUP è diventato maturo e l’”immagine fantasma” che un tempo affliggeva i progettisti di lenti scompare. La fotografia computazionale non assume più il ruolo di “ottimizzazione” e si sposta gradualmente in primo piano, diventando una parte fondamentale del miglioramento della qualità dell’immagine e della qualità dell’immagine.

Se la Light L16 a quel tempo avesse l’attuale “algoritmo”, penso che potrebbe essere una possibilità futura per la fotocamera, ma non è Camera 3.0, è “fotografia computazionale”.

#Benvenuto a seguire l’account WeChat ufficiale di Aifaner: Aifaner (ID WeChat: ifanr), i contenuti più interessanti ti verranno forniti il prima possibile.

Ai Faner | Link originale · Visualizza commenti · Sina Weibo