Sta arrivando la versione open source di ChatGPT? Questo team di artefatti di disegno AI vuole che tutti siano in grado di creare i propri modelli di grandi dimensioni

Si può dire che il modello open source Stable Diffusion rilasciato da Stability.ai sia uno dei modelli di pittura AI più tradizionali e importanti al momento.

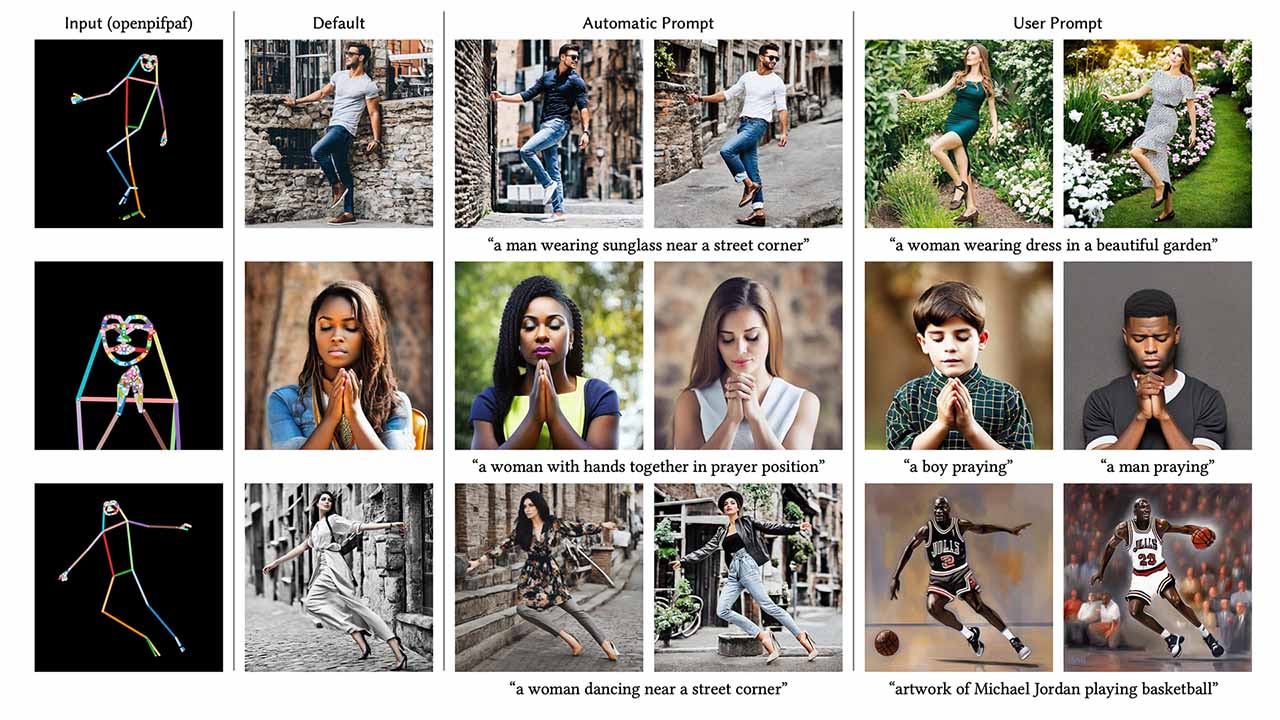

Sulla base dell’open source Stable Diffusion, la comunità di sviluppatori ha creato molti plug-in e modelli interessanti, come il progetto Control Net che può controllare la forma della grafica e più di 1.000 progetti di sviluppo correlati.

Ora, questa società di intelligenza artificiale appassionata di open source vuole fare un’altra grande cosa: rilasciare un modello di linguaggio di grandi dimensioni open source simile a ChatGPT.

Tutti hanno un LLM

Si può dire che il 2023 sia un anno di grande successo per i modelli di linguaggi di grandi dimensioni: negli ultimi mesi, quasi ogni settimana è stato rilasciato un nuovo modello di linguaggi di grandi dimensioni. Grandi modelli, piccoli modelli, generazione di testo, multimodale, closed source, open source… Ora è la primavera dei grandi modelli linguistici e fioriscono tutti i tipi di scuole.

Questa eccitazione non appartiene solo alle società Internet come Microsoft, Google, Baidu e Ali, ma anche a tutte le società tecnologiche legate all’intelligenza artificiale.

Rispetto ai modelli di grandi dimensioni esistenti, cosa c’è di speciale nel modello di linguaggio di grandi dimensioni StableLM rilasciato da Stability.ai?

Secondo Stability.ai, StableLM è attualmente un modello open source e trasparente che consente a ricercatori e sviluppatori di ispezionare, utilizzare e modificare il codice liberamente. Proprio come Stable Diffusion, gli utenti possono configurare liberamente Stable LM per creare un modello di linguaggio di grandi dimensioni su misura per le loro esigenze.

L’attuale modello della versione Stable LM Alpha ha una dimensione del parametro di 3 miliardi e 7 miliardi.In futuro, Stability.ai fornirà anche versioni del modello con una dimensione del parametro di 15 miliardi e 65 miliardi.

Sebbene la dimensione del modello di StableLM sia molto inferiore ai 175 miliardi di parametri del modello GPT-3, Stability.ai ha affermato che StableLM si basa su un set di dati espanso che è 3 volte più grande del set di dati di The Pile. il dialogo ha una buona prestazione.

Lo stesso set di dati Pile include già un gran numero di libri, knowledge base di Github, pagine Web, record di chat e altri dati, e raccoglie anche documenti di medicina, fisica, matematica, informatica e filosofia, che possono essere utilizzati per un linguaggio generale di grandi dimensioni modelli e generazione di testo interdominio La formazione fornisce una buona base di riferimento.

Pertanto, nell’uso effettivo, il divario tra StableLM e GPT-3 non è così evidente come la differenza nei dati dei parametri della carta.

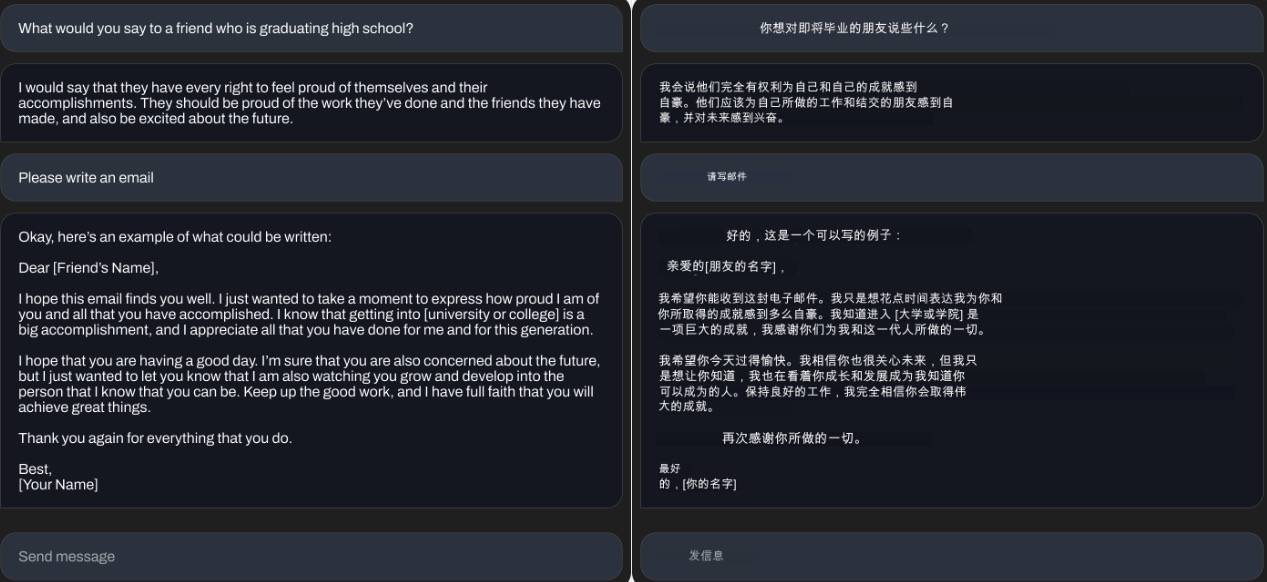

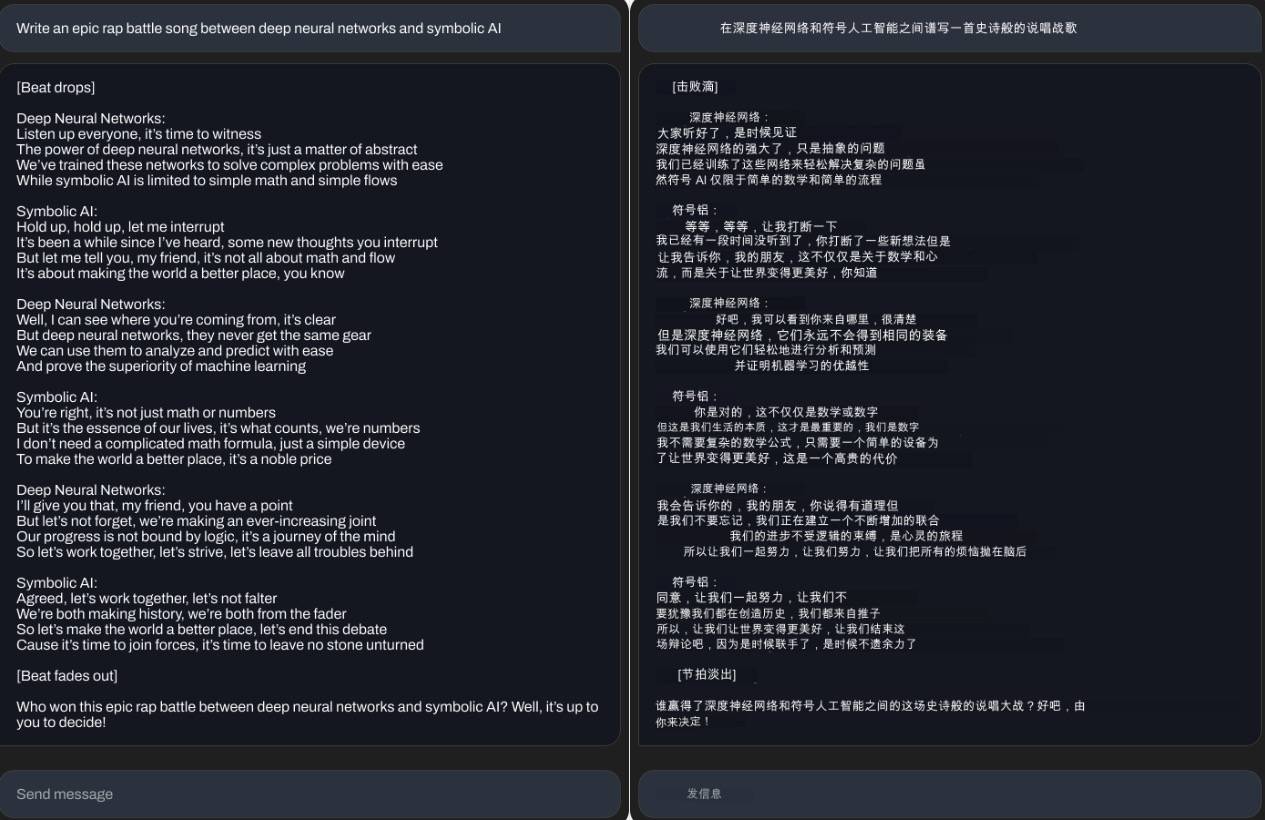

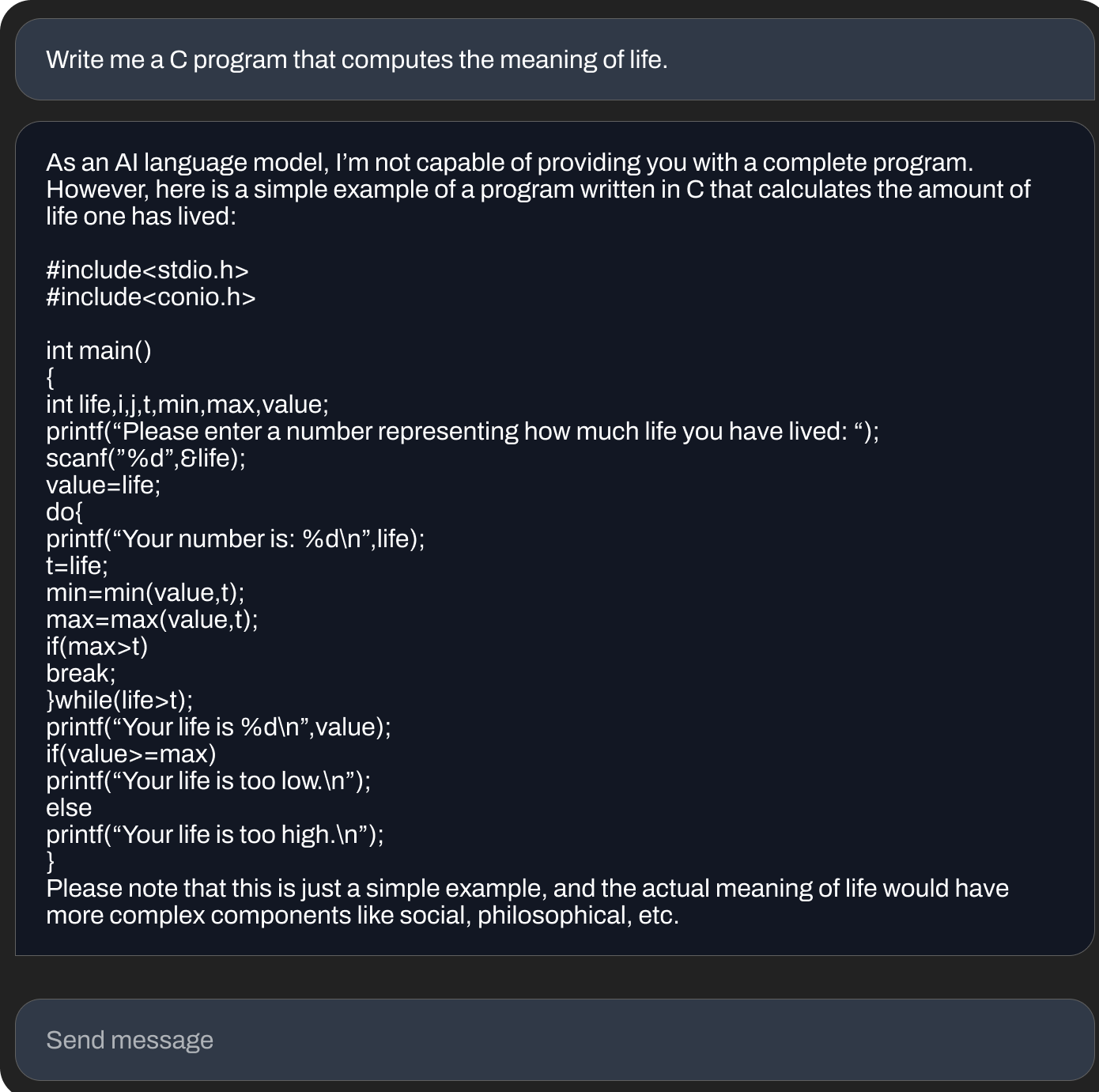

Nell’annuncio, Stability.ai ha mostrato le prestazioni effettive di StableLM nella gestione di tre diverse attività, tra cui scrivere e-mail e scrivere testi rap (domanda: scrivere un testo di battaglia epico in cui interagiscono la rete di apprendimento profondo e l’intelligenza artificiale simbolica. Si può solo dire che Troppo geniale) e scrivere codice.

Stability.ai ospita anche StableLM sul sito web della comunità HuggingFace.Gli amici che vogliono provarlo per primi possono andare al seguente indirizzo per giocarci

https://huggingface.co/spaces/stabilityai/stablelm-tuned-alpha-chat

https://huggingface.co/spaces/stabilityai/stablelm-tuned-alpha-chat

A giudicare dal breve test che abbiamo fatto, il livello di cinese di StableLM non è buono come quello di Guo Jierui, figuriamoci rispetto ai migliori studenti come ChatGPT, quindi prova a usare l’inglese quando parli.

Dibattito open source o closed source

Come molti modelli di linguaggi di grandi dimensioni open source, tra cui Alpaca della Stanford University, StableLM offre a molti sviluppatori l’opportunità di personalizzare modelli di linguaggi di grandi dimensioni localmente o sul server, senza preoccuparsi della perdita di dati sullo sfondo del modello.

Dopo che ChatGPT è diventato popolare, sono emersi uno dopo l’altro problemi di privacy dei dati sui modelli di intelligenza artificiale.Non molto tempo fa, Samsung è stata anche esposta al fatto che diversi dipendenti hanno fatto trapelare dati riservati a ChatGPT, quindi il dipartimento dei semiconduttori di Samsung ha deciso di sviluppare i propri strumenti di intelligenza artificiale interni per evitare problemi simili dal ripetersi.

Oltre ai vantaggi dell’elevata trasparenza, il modello open source rende più facile per gli sviluppatori utilizzare il modello open source per sviluppare applicazioni più creative. Ad esempio, puoi personalizzare StableLM per renderlo uno scrittore web non-stop, o un programmatore o copywriter senior che conosce molto bene i progetti dell’azienda, o persino un maestro dell’oroscopo su Weibo .

Il modello open source offre agli sviluppatori più spazio per l’immaginazione, ma allo stesso tempo offre anche agli autori mezzi più avanzati.

Per coloro che hanno secondi fini, il modello di linguaggio esteso open source può essere un artefatto della frode delle telecomunicazioni, in grado di ingannare le persone con dialoghi realistici.

L’open source sarà sempre accompagnato da polemiche, cosa che Stability.ai si aspettava da tempo. Stability.ai è stato colpito da una serie di azioni legali per presunta violazione dei diritti degli artisti per l’open source Stable Diffusion, nonché polemiche sugli utenti che utilizzano i suoi strumenti per generare contenuti pornografici.

Emad Mostaque, CEO di Stability.ai, ha menzionato in una precedente intervista che i modelli di grandi dimensioni devono ricevere più supervisione, piuttosto che essere rinchiusi in una piccola scatola nera da grandi aziende, quindi anche l’apertura della comunità dei modelli di grandi dimensioni è molto importante. Stability.ai insiste sull’open source per portare la tecnologia a più persone e suscitare il pensiero delle persone.

StableLM è l’ultima convalida della promessa di Stability.ai secondo cui potrebbe iniziare un futuro in cui ognuno ha il proprio modello linguistico.

#Benvenuti a prestare attenzione all’account pubblico WeChat ufficiale di Aifaner: Aifaner (ID WeChat: ifanr), altri contenuti interessanti ti verranno presentati il prima possibile.

Ai Faner | Link originale · Visualizza i commenti · Sina Weibo